Anfang April 2024 bin ich auf das Projekt VLOGGER gestoßen, welches die Art, wie Menschen über Videos beeinflusst werden können, arg verändern könnte. VLOGGER ist ein generisches KI-System zur Generierung eines minutenlangen Videoblogs (d.h. Vlog) von Benutzerbeschreibungen. Ein Foto einer Person reicht – und das KI-System erstellt eine Videopräsentation mit einer Audiospur des betreffenden Menschen.

Der Begriff VLOGGER bzw. VLOG war mir bisher nur aus Plattformen wie YouTube bekannt. VLOG steht für Video-Blog, und ein VLOGGER ist eine Person, die Videos zu einem Sachverhalt erstellt und diese dann seinen Abonnenten auf YouTube etc. bereitstellt. Heißt, eine Kamera mitschleppen, die betreffenden Videos mit Ton aufnehmen, schneiden und dann im Internet einstellen.

KI-Lösung VLOGGER

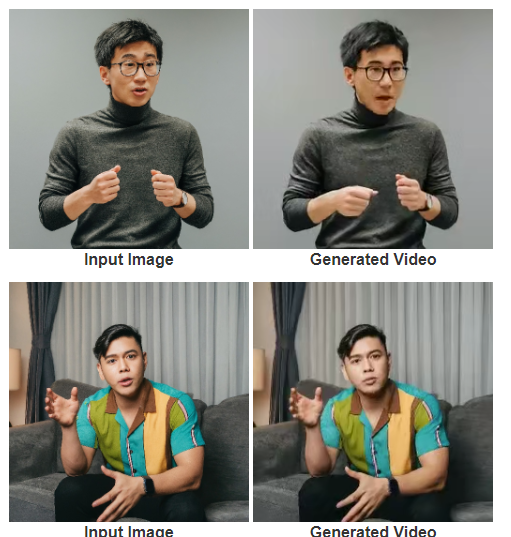

Die KI-Lösung VLOGGER stammt von Google-Forschern, die es wohl geschafft haben, aus einem einzigen Foto und einem Audiotrack so etwas wie realistische Videos zu erstellen. Ich selbst bin Anfang April 2024 auf die GitHub-Projektseite von Enric Corona gestoßen. Auf der Seite VLOGGER: Multimodal Diffusion for Embodied Avatar Synthesis findet sich ein Vorschlag eines Google-Autorenkollektivs.

Die Forscher schlagen mit VLOGGER eine Methode zur text- und audiogesteuerten Erzeugung sprechender menschlicher Videos aus einem einzigen Eingabebild einer Person vor. VLOGGER baut auf dem Erfolg der jüngsten generativen Diffusionsmodelle auf. Die benutzte Methode besteht aus:

- einem stochastischen Mensch-zu-3d-Bewegungs-Diffusionsmodell und

- einer neuartigen diffusionsbasierten Architektur, die Text-zu-Bild-Modelle sowohl mit zeitlichen als auch räumlichen Kontrollen anreichert.

Dieser Ansatz ermöglicht die Generierung von qualitativ hochwertigen Videos mit variabler Länge, die sich durch hochgradige Repräsentationen menschlicher Gesichter und Körper leicht steuern lassen. Im Gegensatz zu früheren Arbeiten erfordert laut den Forschern die verwendete Methode kein Training für jede einzelne Person, ist nicht auf Gesichtserkennung und -beschneidung angewiesen, generiert das komplette Bild (nicht nur das Gesicht oder die Lippen) und berücksichtigt ein breites Spektrum von Szenarien (z. B. sichtbarer Torso oder unterschiedliche Identitäten der Personen), die für die korrekte Synthese von kommunizierenden Menschen entscheidend sind.

Die KI-Lösung VLOGGER wurde anhand von drei verschiedenen Benchmarks bewertet. Die Ergebnisse zeigen, so die Forscher, dass das vorgeschlagene Modell andere State-of-the-Art-Methoden in Bezug auf Bildqualität, Identitätserhalt und zeitliche Konsistenz übertrifft.

Eine ausgiebige Beschreibung des Ansatz samt generierter Beispielvideos findet sich auf der GitHub-Seite VLOGGER: Multimodal Diffusion for Embodied Avatar Synthesis. Auf arXiv gab es bereits im März 2024 diesen Beitrag zum Thema – die PDF-Fassung lässt sich hier schneller abrufen. Andreas Sobing hat das Thema in diesem Youtube-Video aufgegriffen und von Golem gibt es diesen Beitrag vom März 2024.

Mir selbst ist das Thema zum 1. April 2024 auf X unter die Augen gekommen. Ich hielt es erst für einen April-Scherz und habe das Ganze zurück gestellt, bis ich verifiziert hatte, dass die ursprünglichen Veröffentlichungen wirklich existierten und deutlich vor dem 1. April 2024 veröffentlicht wurden.

MVP: 2013 – 2016

MVP: 2013 – 2016

Ich finde das beängstigend. Es wird bald so weit sein, dass echtes von unechtem nicht mehr zu unterscheiden und vor allem nicht mehr verifizierbar sein wird. Die ganze Welt arbeitet geradezu auf diesen Punkt hin. Aus meiner Sicht wird es irgendwann eine Grenze geben, ab der Informationen aus keiner Quelle mehr vertrauenswürdig sein können. Es sei denn, man hat es selbst gesehen oder erlebt. Die Informationsmedien werden damit überholt, denn sie bauen auf das Vertrauen zu den Journalisten und Autoren. Nur sehr wenige Menschen prüfen wirklich die Quellen. Meistens nur die Journalisten selbst. Tatsächlich vertraut die breite Masse auf bestimmte Kanäle oder Personen, dass diese nur verifiziertes veröffentlichen. Wenn dieses Vertrauen missbraucht wird, ob wissentlich oder unwissentlich, ist es vorbei. Die Medienlandschaft wird dann einen massiven Umbruch erleben.

Solche Tools befeuern gerade zu Verschwörungstheoretiker und machtbesessene Diktatoren. Deshalb meine ich, es ist an der Zeit Regeln für solche Tools einzuführen. Z.B. eine kryptografisch, auf Blockchain basierte und verifizierbare Markierung, die ein so generiertes Video als Fake kennzeichnet. Aber auch umgekehrt sollten auf Blockchain basierte Schlüssel-Plattformen aufgebaut werden, die echte und verifizierte Nachrichten bestätigen. Nur so wird es auf längere Sicht möglich sein, eine Unterscheidung zu treffen.

das hast du doch heute schon… Informationen kannst du nur vertrauen, wenn du selbst recherchiert hast! Sorry aber Journakisten und recherchieren, lol das machen die wenisgten heute noch! Da siehst du an den Clickbait Nachrichten sehr deutlich, wo die Prioritäten liegen!

Fakes waren aber noch nie ein reines WWW Problem, siehe HitlerTagebücher; Relotius usw. Der Homo Saphiens will manipuliert werden!

In der Zukunft wird selbst recherchieren halt aufwendig und es gilt wie du sagtest: entweder du warst selbst dabei oder es ist nicht wahr… naja gewisse Dinge wie Naturgesetze kannst du schon vertrauen ohne lange nachzudenken

;-P zumindest als präPISA Bürger. Die PostPISA schaffen ja nicht mal das mehr.

Idio(t)crazy ist längst keine Fiction mehr, sondern bittere Realität.

>> das hast du doch heute schon… Informationen kannst du nur vertrauen, wenn du selbst recherchiert hast!

Ich vertraue Herrn Borns Recherchen ;-))

In gewisser Weise gebe ich dir aber recht. Wie Yossarian unten schreibt, es ist noch immer zu unterscheiden. Die Frage ist halt, wie lange noch. In einigen Bereichen muss man aber inzwischen tatächlich selbst recherchieren, wenn man etwas genau wissen will. In sofern…

Hast du dir die Beispielvideos mal angeschaut?

Das ist durchaus beeindruckend in Bezug auf die Technik (nur ein Bild), aber eine realistische Täuschung ergibt das Endergebnis nicht.

Ich würde echt etwas gelassener bleiben. Es ist durchaus beeindruckend, was man mit neuronalen Netzen mittlerweile hinbekommt, aber es bleiben dennoch ganz zentrale Limitierungen und als Mensch erkennt man die auch recht schnell.

Unterhalte dich z.B. mal eine halbe Stunde mit ChatGPT. IMO reicht das schon, um die Täuschung wahrzunehmen. Wenn du es gezielt darauf anlegst die Grenzen herauszufinden, dann geht es sogar noch schneller.

Und Informationen zu hinterfragen ist nie verkehrt. Wenn diese Techniken das ein wenig mehr ins allgemeine Bewusstsein bringen, dann würde ich persönlich das sogar eher positiv bewerten.

Im Moment ist das so. Da stimme ich dir zu. Ich sehe da nur eine Entwicklung auf uns zukommen. Du kannst darauf vertauen, dass die Qualität solcher Videos und auch der ChatGPT Texte immer besser werden. Am Ende sehe ich aber auch Chancen.

Ich empfehle, mal "Nachricht von Ella" anzusehen, was bereits möglich ist. Ich halte das für sehr realistisch, speziell, wenn man die dargestellte Person nicht intensiv kennt.

invidious. poast. org/watch?v=F4WZ_k0vUDM

" Regeln für solche Tools einzuführen. Z.B. eine kryptografisch, auf Blockchain basierte und verifizierbare Markierung, die ein so generiertes Video als Fake kennzeichnet. "

Falsch herum gedacht, denn wer täuschen will, wird auch nicht Kennzeichnen! Wenn überhaupt, müsste man verifizierte Informationen als solche Kennzeichnen. Alles was nicht mit dem Zertifikat einer seriösen Quelle versehen ist, müsste dann als nicht vertrauenswürdig betrachtet werden.

Und welche Institution oder Behörde soll diese Differenzierung zw. Fake und Real/Seriös zertifizieren? Womöglich der TÜV? Ausgerechnet der TÜV?! Oder eine politisch abhängige staatliche Stelle? Oder zertifizieren die "Qualitäts"-Medien sich dann selbst?

Es scheint keine vernünftige Lösung zu geben, außer eben gar nichts mehr zu glauben … Ein System auf die Spitze getrieben zerstört sich am Ende selbst.

Wer kennt die Serie "Fringe"? Ihr erinnert euch? "ZERSTÖRUNG DURCH FORTSCHRITT" . . . da sind wir ganz nah dran . . .

"Am Ende sehe ich aber auch Chancen."

Katastrophen sind halt auch nur dornige Gelegenheiten. Wir haben in der EU sogar Rechtsgrundlagen für die Abwehr des Missbrauchs dieser Technik(en).

Ich sehe da den Gesetzgeber im Zugzwang, der raschestmöglich eine Kennzeichnungspflicht (zb "zu 50% mit KI erstellt") umsetzen muss, auf deren Umgehung strenge Strafen stehen.

Das größte Problem sind imho nicht Fälschungen, denn die gab es immer. Sondern, dass KI darauf trainiert wird, den Menschen zu "überzeugen". Die Sinne des Menschen sind aber sehr limitiert. Das Ergebnis ist dann etwas, dass für uns nett aussieht, aber dem wahnsinnig viele reale Informationen fehlen. Damit bauen wir unsere Zukunft auf extrem reduzierten Informationen auf, die uns dann irgendwann fehlen wird.

Ein ähnliches Beispiel sind die CGI Effekte älterer Filme, die für die damalige Technik nett ausgesehen haben, aber nicht in hohen Auflösungen vorliegen und damit fast wertlos geworden sind. Das wird uns bei KI massiv auf die Füße fallen, egal ob es um Texte, Bilder oder Videos geht. Über wissenschaftliche Studienauswertungen spreche ich da noch gar nicht.

Das Verbot ist dann so wirksam, wie das Messer- und das Schusswaffenverbot:

Der gemein Bürger hat sich dran zu halten oder würde hart bestraft, der Kriminelle lacht sich einen Ast.

Spannend auch, wie man die unbewusste Weiterverbreitung 'verbotener' fremder Videos werten wollte, ob damit über dem Bürger das Damoklesschwert der Bestrafung hinge, wenn er KI-Inhalte nicht erkannte – und wie weit das mit Art. 5 GG vereinbar wäre (das Verbot bewirkte zumindest einen chilling-effekt).

Die einzigen Regelungen die der Staat ernsthaft und mit Nachdruck bis zur Perfektion ins allerkleinste hinein überwacht, kontrolliert und bei Verstoß Sanktioniert, sind die – den kleinen Normal-Bürger betreffenden – Steuer-Regelungen.

Im Übrigen haben die ständigen Rufe nach staatlicher Regulierung kaum noch Effekt. All die vielen Gesetze die wir haben werden häufig kaum bis gar nicht kontrolliert. Man denke mal an die Covid-Zeit zurück, als es die Privatwohnungen betreffende Regelungen gab. Oder andere Regeln die faktisch nicht flächendeckend kontrollierbar waren. Der Staat kann nicht "unendlich" viel Personal zur Kontrolle von allem Einsetzen. Und zugleich behindert sich unser Staat selbst, immer dann wenn gewisse Lobbyisten (Politiker) mal wieder mit dem berüchtigten Datenschutz um die Ecke kommen . . . die gleiche Partei die momentan so tut als wolle sie ernsthaft die "Digitalisierung" des Staates auf Teufel komm raus voran treiben, hatte genau das seit Jahrzehnten torpediert und verhindert, zb. bei Behörden übergreifenden Datenabgleichen, die es nun bräuchte um das Ziel von Frau Paus (Kindergrundsicherung) ohne 5000 neue Stellen zu erreichen! Was in der Tat ein Witz in sich ist, wenn man noch Schröders Sprüche vom "schlanken Staat" kennt… das Gegenteil war passiert. Allerdings wurde Personal überall dort abgebaut wo richtig gearbeitet wird. Immer noch mehr Stellen gibt es vor allem dort, wo sowieso keiner wirklich Arbeitet.

Es mag noch keiner bemerkt und begriffen haben, aber dieses System ist insgesamt am Ende. Der Kollaps kommt irgendwann … kann Morgen sein, oder in 30 Jahren oder wer weiß. Es besteht wenig Hoffnung das in der Politik noch mal der "gesunde Menschenverstand" Einzug hält. Und wo der Schwachsinn regiert, wächst das Chaos. Und dieses ist nicht zuverlässig vorhersagbar … nur der Zusammenbruch als solcher wird mit der Zeit immer klarer erkennbar werden, aber nicht der Zeitpunkt wo nichts mehr geht.

Statt an einer Revolution von Unten glaube ich eher an den systemischen Zusammenbruch, womöglich aus ganz anderen Gründen von außen, gegen die man sich nicht ausreichend gerüstet hatte, wie zb. Cyberangriffe … oder ein globales Naturereignis, gegen das ein einzelnes Land sich nicht wirksam Absichern kann (Kometen-Einschlag, Super-Vulkan-Ausbruch, Klimafolgen …, oder eine Pandemie ohne wirksames Impfmittel ist aktuell eher sehr wahrscheinlich bevorstehend)

Die Frage welche Medienberichte echt und welche falsch sind, wird dann eh unser kleinstes Problem sein, bei der täglichen Suche … nicht etwa nach Toilettenpapier, sondern nach sauberem Wasser und etwas essbarem … bzw. im Winter auch nach Wärme …

Wenn auch etwas off-topic, zum Thema KI gibt es auf Kuketz Blog einen aus meiner Sicht lesenswerten Gastbeitrag von Herrn Lacrosse (Stand: 02.04.2024),

der den Datenschutz von KI kritisch betrachtet:

https://www.kuketz-blog.de/ki-und-datenschutz-eine-kritische-betrachtung/