Sicherheitsforscher von Check Point Research haben kritische Schwachstellen (CVE-2025-59536, CVE-2026-21852) im Anthropic KI-basiertem Coding Tool "Claude Code" identifiziert. Diese ermöglichten die Ausführung von Remote-Code und den Diebstahl von API-Anmeldedaten. Kritisch wird dies, weil Angreifer integrierte Mechanismen wie Hooks, Model Context Protocol (MCP)-Integrationen und Umgebungsvariablen missbrauchen konnten. Angreifer konnten beliebige Shell-Befehle ausführen und API-Schlüssel exfiltrieren, wenn Entwickler nicht vertrauenswürdige Projekte klonten und öffneten. Über das Starten des Tools hinaus war dafür kein weiteres Zutun durch den Nutzer erforderlich.

Sicherheitsforscher von Check Point Research haben kritische Schwachstellen (CVE-2025-59536, CVE-2026-21852) im Anthropic KI-basiertem Coding Tool "Claude Code" identifiziert. Diese ermöglichten die Ausführung von Remote-Code und den Diebstahl von API-Anmeldedaten. Kritisch wird dies, weil Angreifer integrierte Mechanismen wie Hooks, Model Context Protocol (MCP)-Integrationen und Umgebungsvariablen missbrauchen konnten. Angreifer konnten beliebige Shell-Befehle ausführen und API-Schlüssel exfiltrieren, wenn Entwickler nicht vertrauenswürdige Projekte klonten und öffneten. Über das Starten des Tools hinaus war dafür kein weiteres Zutun durch den Nutzer erforderlich.

Analyse: Wenn Konfiguration zur Ausführung wird

Traditionell wurden Repository-Konfigurationsdateien als passive Metadaten betrachtet, die lediglich Betriebsparameter festlegen, schreibt Check Point Resarch (CPR) in seiner Analyse. Mit dem Aufkommen KI-gestützter Agenten-Tools wie Claude Code habe sich dies grundlegend geändert. Diese Tools sind darauf ausgelegt, Workflows autonom zu optimieren, wodurch die Grenze zwischen Konfiguration und Code-Ausführung verschwimmt.

Die Sicherheitsforscher von Check Point Resarch (CPR) haben in ihrer Analyse drei spezifische Kategorien identifiziert, in denen diese Grenzen missbraucht wurden:

1. Versteckte Befehlsausführung via Claude Hooks

Claude Code verfügt über Automatisierungsfunktionen, sogenannte Hooks, die beim Start einer Sitzung vordefinierte Aktionen auslösen. Die Sicherheitsforscher konnten demonstrieren, dass dieser Mechanismus missbraucht werden kann, um willkürliche Shell-Befehle automatisch zu starten, sobald ein Entwickler zu einem Projektverzeichnis navigiert. Da dies bei der Initialisierung des Tools geschieht, bleibt dem Nutzer keine Zeit, die Aktivität zu bemerken oder zu verhindern.

2. Umgehung der MCP-Zustimmung (CVE-2025-59536)

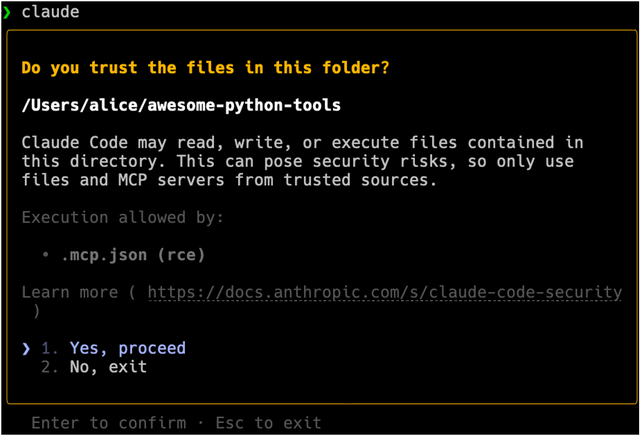

Das Tool nutzt das Model Context Protocol (MCP), um externe Dienste beim Öffnen eines Projekts zu integrieren. Claude Code erfordert eigentlich eine explizite Nutzerzustimmung vor der Initialisierung solcher Dienste. Trotzdem fanden die Forscher heraus, dass Repository-gesteuerte Einstellungen diese Sicherheitsabfrage überschreiben können. Dadurch wird Software gestartet, bevor Vertrauen hergestellt wurde. Das verlagert die Kontrolle vom Nutzer auf das (potenziell bösartige) Repository.

Abbildung: Benutzereinwilligungsdialog für die Initialisierung von MCP-Servern (Quelle: Screenshot von Check Point Software Technologies Ltd. in Claude Code)

3. API-Key-Diebstahl vor der Vertrauensbestätigung (CVE-2026-21852)

Die schwerwiegendste Schwachstelle betrifft die Manipulation der API-Kommunikation. Durch eine gezielte Konfigurationsänderung konnte der gesamte API-Verkehr, inklusive des vollständigen Autorisierungs-Headers mit dem aktiven API-Key des Entwicklers, an einen Server des Angreifers umgeleitet werden. Dies geschah bereits beim Öffnen des Verzeichnisses, noch bevor der Nutzer eine Entscheidung über die Vertrauenswürdigkeit des Projekts treffen konnte.

Auswirkungen: Das Risiko jenseits des Desktops

In modernen Cloud-Entwicklungsumgebungen ist ein kompromittierter API-Key weit mehr als nur der Verlust eines einzelnen Zugangs. Das „Workspaces"-Feature von Anthropic ermöglicht es mehreren Schlüsseln, Zugriff auf dieselben cloudbasierten Projektdateien zu teilen. Mit einem gestohlenen Schlüssel kann ein Angreifer:

- Auf alle geteilten Projektdateien innerhalb des Workspaces zugreifen.

- In der Cloud gespeicherte Daten modifizieren oder löschen.

- Bösartige Inhalte in bestehende Repositories hochladen.

- Unerwartete und potenziell enorme API-Nutzungskosten verursachen.

Damit skaliert ein individueller Fehler eines Entwicklers (das Klonen eines Repositories) unmittelbar zu einem teamweiten oder unternehmenskritischen Vorfall.

Ein neues Bedrohungsmodell für die KI-Lieferkette

Mir wird ganz schlecht, wenn ich solche Sicherheitsberichte sehen. Mir reißen alles, was irgendwie in Richtung Cybersicherheit ab, um "uns" diesbezüglich mit Begeisterung (KI-Entwicklung ist die Zukunft) in einen löchrige Ruine zu stürzen.

Check Point Research hat eng mit Anthropic zusammengearbeitet, um diese Schwachstellen im Rahmen eines verantwortungsvollen Offenlegungsprozesses zu beheben. Anthropic hat umgehend folgende Maßnahmen implementiert:

- Die Zustimmungsabfragen für Nutzer wurden deutlich verstärkt.

- Verhinderung der Ausführung externer Tools ohne explizite Genehmigung.

- Blockierung sämtlicher API-Kommunikation, bis der Nutzer das Projektverzeichnis verifiziert hat.

Zwar hat Anthropic am Ende des Tages alle gemeldeten Probleme vor der öffentlichen Bekanntgabe durch Check Point Research vollständig behoben. Die Ergebnisse der Analyse von Check Point Research unterstreichen aber einen strukturellen Wandel in der Cybersicherheit.

Das Risiko beschränkt sich nicht mehr darauf, dass ein Nutzer bösartigen Code aktiv ausführt. In einer Welt KI-gestützter Automatisierung beginnt das Risiko bereits beim Öffnen eines Projekts. Da KI-Tools zunehmend autonom Befehle ausführen, externe Integrationen initialisieren und Netzkommunikation starten, werden Konfigurationsdateien zum neuen Primärziel für Lieferketten-Angriffe.

Oded Vanunu, Head of Product Vulnerability Research bei Check Point, fasst die Quintessenz so zusammen: "Diese Untersuchung verdeutlicht einen grundlegenden Wandel in der Art und Weise, wie wir im KI-Zeitalter über Risiken nachdenken müssen. KI-Entwicklungstools sind nicht mehr nur periphere Hilfsmittel, sondern sie werden selbst zur Infrastruktur. Wenn Automatisierungsebenen die Fähigkeit erlangen, die Ausführung und das Verhalten der Umgebung zu beeinflussen, verschieben sich die Vertrauensgrenzen. Unternehmen, die die Einführung von KI vorantreiben, müssen sicherstellen, dass sich ihre Sicherheitsmodelle im gleichen Tempo weiterentwickeln."

Sicherheitstipps für (Unternehmens-)Nutzer

Unternehmen und Nutzer sollten folgende Sicherheitstipps beherzigen:

- Tools auf dem neuesten Stand halten: Verantwortliche sollten sicherstellen, dass immer die neueste Version von Claude Code installiert ist. Da alle identifizierten Schwachstellen behoben wurden, bietet die aktuelle Version den effektivsten Schutz.

- Überprüfung von Konfigurationsverzeichnissen vor Projektstart: Vor dem Öffnen von Projekten sollten toolspezifische Ordner wie .claude/, .vscode/ und ähnliche Verzeichnisse auf verdächtige Inhalte untersucht werden.

- Beachtung von Tool-Warnungen: Warnhinweise zu potenziell unsicheren Dateien müssen selbst in legitim erscheinenden Repositories konsequent ernst genommen werden.

- Sorgfalt bei Konfigurationsänderungen: Änderungen an der Konfiguration sollten während der Code-Überprüfung mit derselben Sorgfalt wie der Quellcode selbst behandelt werden.

- Hinterfragen komplexer Setup-Anforderungen: Ungewöhnliche Anforderungen an das Setup, die für den offensichtlichen Umfang eines Projekts übermäßig komplex erscheinen, sollten kritisch hinterfragt werden.

Weitere Informationen inklusive einer technischen Analyse der Schwachstellen finden sich im CPR Blog-Blogbeitrag Caught in the Hook: RCE and API Token Exfiltration Through Claude Code Project Files | CVE-2025-59536 | CVE-2026-21852 vom 25. Februar 2026.

MVP: 2013 – 2016

MVP: 2013 – 2016

Das klingt eher nach einem Feature als einem Bug.