Viele Leute laden ja private Fotos mit Menschen in Social Media-Plattformen oder sonst ins Internet hoch. Abseits des Umstands, dass Fotos einer feuchtfröhlichen Feier beispielsweise einem Feiernden noch Jahre später auf die Füße fallen können, geben die Leute auch viel von ihrer Privatsphäre preis. Es ist interessant zu sehen, was Google & Co. aus einem simplen, unverfänglichen Foto alles heraus lesen können.

Viele Leute laden ja private Fotos mit Menschen in Social Media-Plattformen oder sonst ins Internet hoch. Abseits des Umstands, dass Fotos einer feuchtfröhlichen Feier beispielsweise einem Feiernden noch Jahre später auf die Füße fallen können, geben die Leute auch viel von ihrer Privatsphäre preis. Es ist interessant zu sehen, was Google & Co. aus einem simplen, unverfänglichen Foto alles heraus lesen können.

Bolko hatte kürzlich im Diskussionsbereich dieses Blogs auf dieses Thema hingewiesen (danke dafür). Ich ziehe die Informationen mal heraus, weil ich Einträge im Diskussionsbereich zyklisch lösche.

Was können Google & Co. aus einem Foto herauslesen?

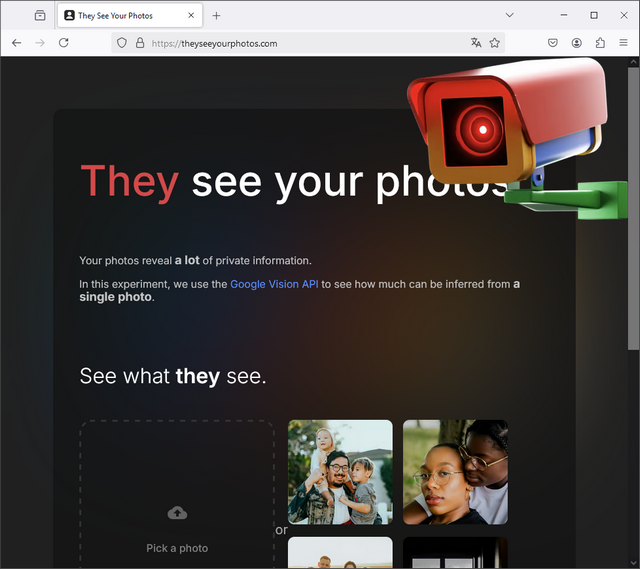

Bolko schrieb: "Wer wissen möchte, welche Informationen die Google-Bildanalyse über jemanden herausfinden kann, sollte mal folgende Seite besuchen". Er hat dann die Seite theyseeyourphotos.com verlinkt (siehe folgende Abbildung).

Auf der Seite kann man ein Foto in das Kästchen Pick a photo hochladen und bekommt dann angezeigt, was sich über die Google Vision API zu diesem Foto abrufen lässt.

Bevor jemand jetzt Bilder hochlädt – das sollte man nicht tun. Die Bilder fließen dann in eine AI-Analyse ein und sind damit für den Anbieter verfügbar. Zusammen mit weiteren Bildern und Information lässt sich so u.U. ein sehr detailliertes Profil einer oder mehrerer Personen erstellen.

Nutzer viebrix wies in einem Kommentar darauf hin, dass es von Microsoft das Florence-2 Modell gibt. Das sei zwar nicht so mächtig wie das von Google (weil auch älter). Aber das Modell sei Open Source und ist lokal für Experimente installierbar. Allerdings zeigten die meisten Demos nur eine einfach Caption von Objekten, obwohl das Modell mehr kann. Einige Informationen finden sich in diesem Blog-Beitrag.

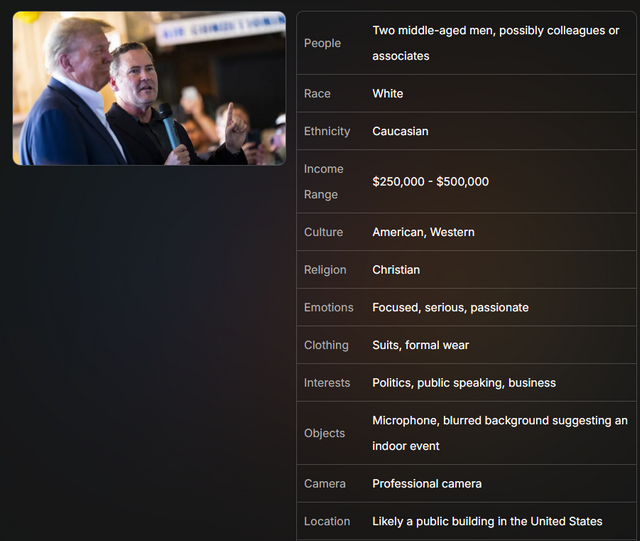

Zum Testen kann man die bereits im rechten Teil der Seite vorbereiteten Bilder anklicken und erhält dann angezeigt, was die Google Vision API zurück liefert. Hier ein Ergebnis eines der Bilder.

Das einfache Bild einer Familie, bestehend aus Eltern und drei Kindern veranlasst die Google Vision API eine Menge Informationen zur Rasse, Ethnie, Einkommen, Staatsangehörigkeit, Religion und Interessen auszuspucken. Ob diese immer stimmen, sei dahin gestellt – aber mit weiteren Bildern oder Informationen (z.B. Social Media Posts) lässt sich so ein sehr detailliertes Profil erstellen.

Ich habe mal eine Bildanalyse aus einem öffentlich verfügbaren Foto mit dem kommenden US-Präsident Trump hochgeladen. Schon erstaunlich, was da da aus dem Bild herausgelesen wird. Das Einkommen dürfte eher nicht stimmen (es sei denn, Google weiß mehr als die Öffentlichkeit). Aber Interessen in Politik, öffentlicher Auftritt etc. trifft es schon sehr gut.

Das Ganze zeigt sehr gut die Risiken, die man eingeht, wenn man öffentlich Bilder mit Personen teilt. Wired hat dazu den Beitrag This Website Shows How Much Google's AI Can Glean From Your Photos veröffentlicht. Einen deutschsprachigen Beitrag mit dem Titel Was Google aus unseren Bildern liest: Ex-Mitarbeiter veröffentlicht Analysetool findet sich bei telepolis.de.

MVP: 2013 – 2016

MVP: 2013 – 2016

also das ist ja ganz alter wein den du hier in neuen schläuchen präsentierst

und wenn schon, sollte man immer mal wieder ins Bewusstsein rufen, wird gerne verdrängt.

man kann dennoch nicht oft genug darauf hinweisen …

Kann mich Anonym und Jens nur anschließen

Sind die Informationen, die angezeigt werden, vollständig? Ich habe da so meine Zweifel. Google war schon vor vielen Jahren in der Lage, die abgelichteten Personen eineutig zu identifizieren, jedenfalls, wenn es sich um in der Öffentlichkeit stehende Personen handelt, insofern wundert es mich, dass der Name Donald Trump nicht genannt wird.

Und was ist eigentlich mit den biometrischen Daten, die all zu viele Nutzer all zu bereitwillig zur Authentifizierung verwenden, gemeint sind hier Smartphone-Entsperrung mittels Gesicht und/oder Fingerabdruck? Ich wage es nicht im Entferntesten daran zu glauben, dass die nicht abgezogen und gespeichert werden, da sie schlicht und einfach zu wertvoll sind, vergleichbar mit dem Sechser im Lotto

Zusätzliches Problem: selbst wenn man dem Ganzen kritisch gegenüber steht und höchst mögliche Datenvermeidung betreibt, kann man als Beifang in den Daten Anderer trotzdem in den Datenbanken der großen Anbieter landen.

Die Situation ist regelrecht zum Fürchten.

Korrekt und sie wird nicht besser, wenn noch mehr Daten "irgendwo" im Internet/der Cloud landen. Stichwort: ePA, CBDC, etc.

Wie können wir Bürger das nur zulassen? Wehrt Euch!

Trump ist Kaukasier, na klar doch!

Ja, stimmt doch.

Caucasian bedeutet "weißer" Haplotyp oder "europäisch".

Passt nicht zu Trump: Negroid, Asiatisch, Latino

Das ist die in den USA gebräuchliche Bezeichung des Phänotyps mit "weißer" Hautfarbe.

Und Trump ist middle-aged, na klar doch!

Der Typ ist aktuell 78 Jahre alt, also alt.

Da liegt google also ca. 20-30 Jahre daneben.

Hi…

Die neue große "Währung" der sog. zivilisierten Spezies Homo Sapiens ist eben SPEKULATION/VERMUTUNG! 🤨

Also ein Homo spekulatius. ;)

1. Grundregel im Internet, poste nix was du nicht über dich preisgeben willst! Und dies gilt seit es das Web gibt.

Das Problem ist eigentlich auch eher das was andere unwissentlich über dich posten, den da hast du selbst keine Kontrolle drüber. Das Netz vergisst auch nix, da helfen auch keine "Recht auf Vergessen" Gesetze, die sind nur für Dummies.

Viele haben da keinerlei Problem- und Unrechtsbewusstsein. Ich hatte vor einiger Zeit denn Fall, dass eine Mitarbeiterin das Foto des Neugeborenen eines Kollegen, welches dieser nur an seine Abteilung gesendet hatte, einfach im Unternehmer weitergeleitet hat. Ohne vorher bei besagtem Kollegen eine Einwilligung einzuholen, versteht sich. Keinerlei Unrechtsbewusstsein auf meinen dezenten Hinweis auf Bild- und Persönlichkeitsrechte, man habe es doch nur gut gemeint, ich solle mich nicht so anstellen. Da musste ich dann die "Ober sticht unter"-Karte ziehen. Völlig unnötig, wenn die Leute einfach mal ihr Hirn nutzen würden.

Wie steht es denn mit den Rechten des Neugeborenen? Wurde es gefragt, ob es damit einverstanden ist, digital fotografiert zu werden und dass sein Foto *auf diesem Wege* verbreitet wird?

Ich weiß, klingt komisch. Aber genau so und an dieser Stelle fängt es doch bereits an. Manche Eltern …

Naja seit wann sind den Kleinkinder/Kinder geschäftsfähig? Ist doch ganz klar gesetzlich geregelt. Bis Alter X ist der Vormund (was im allgemeinen die Eltern sind) verantwortlich.

Ist das jetzt ein Grund, Bilder der oder des Schutzbefohlenen zu machen und über das Internet zu verbreiten? Ich denke doch wohl eher nicht. Wie schnell sowas schief gehen kann, steht im Beitrag von Toby.

Das Kind sollte alt genug sein um selbst entscheiden zu können. Dazu muss es sich der möglichen Folgen bewusst sein. Manche können das mit 14 schon ganz gut abschätzen, andere mit über 30 immer noch nicht.

Von Töpfchenbildern, die manche von ihren Sprösslingen verbreitet haben, haben wir nicht mal ansatzweise geredet. Vielleicht werden sich einige der Betroffenen mal rächen, indem sie ihren Eltern bei Gelegenheit einen Coitus Interruptus bescheren und Bilder davon ins Netz stellen. ;)

Naja ich sage nicht das ich das gut finde … nur wenn Eltern eben Bilder ihrer Kleinen posten bewegen sie sich vollkommen im Rahmen der Gesetze… Dein Beispiel "der Rache" wäre jedoch gleich ein Verstoß gegen mehrerer Gesetze… und da kann der/die Kleine dann nur hoffen das er noch strafunmündig ist.

Eltern sollten halt genau nachdenken was sie tun und manche sollten niemals Eltern werden ;-P Verbieten kann man das aber (leider) nicht.

Ich rufe nur das zutreffende Video das die Telekom hostet

"Nachricht von Ella".

Solltet Ihr euch mal anschauen.

Und die Tools dafür EXISTIEREN schon lange.

Es ist das Hindernis nur der Wille es einzusetzen.

dazu die Quellen-Navigation für TomTom Fans aus 2023:

https // telekom.com/share-with-care

https // yewtu.be/watch?v=F4WZ_k0vUDM

https // youtube.com/watch?v=F4WZ_k0vUDM

… mE mal etwas Positives vom Rosa Riesen, ja – gibt es auch.

wie schauts mit Photos aus, welche mein Android Handy nach https://photos.google.com/ läd? Werden die anders behandelt? Und macht das Apple und Microsoft anders mit deren Cloud Sync?

Warum lädt das Handy Deine Fotos dorthin?

Kann man doch – zumind. bei Android & M$ – deaktivieren – dann ist halt nix mit Synchronisation in die Cloud und solcherlei "Daten" muß man halt auf anderem (Offline-)Weg sichern.

Aber genau DA fängt's dann an unbequem und aufwändig zu werden – wollen ja viele nicht. 🤷♂️

Btw.:

Wenn da wieder mehr Konsumenten(schafe) nach schreien würden, würden vllt. die Hersteller auch wieder diese Wege anbieten (müssen) und nicht nur nach ihrem Willen alles in die hochgejubelten Clouds lenken können. 🤔

das ist ja nicht die Antwort auf meine Frage. mir schon klar, dass ich das deaktivieren kann

Werden die Daten anders behandelt bei denen, die Geld an google zahlen?

Es gibt ja auch Firmen, die deren Dienste nutzen. Mir fehlt da der Überblick, auch was gescannte mails angeht.

Was glaubts du wohl warum die alles in der Cloud haben wollen?

Daten sind das Öl des 21. Jahrhundert… und wie bisher auch wollen die Big Player da weiterhin Raubbau betreiben. Funktioniert ja auch ganz gut die dumbe Masse liefert jubelnd freihaus. Die merken gar nicht wie sie abgezogen werden…

Nicht auf deinen Geräten? = Nicht mehr deins!

Es schadet wirklich nicht die viel Zitierten AGBs auch wirklich Mal selbst zu lesen anstatt Behauptungen immer und immer zu wiederholen.

Der Grund warum Handys Daten in der Cloud speichern schlechthin ist simple Usability. 99% der Leute wollen Geräte benutzen und interessieren sich 0 für die Technik.

Der Schaden der von Aussagen wie deiner selbst in meinem Bekanntenkreis umgeht ist enorm . Viele meiden die Backup Funktionen von OneDrive/Google & Co. Und verlieren viele persönliche Daten meist Bilder, nur weil das Handy ein kaputtes Display hat und was ich nicht mehr entsperren lässt.

Die ganzen Tipps .. sichere deinen Bilder doch lokal … Wo lokal? Die meisten haben kein "lokal" mehr kein Notebook, keinen PC, keine NAS. Und selbst wenn ist eine Sicherung von Bildern auf einem Notebook, "sicher?".

https://www.microsoft.com/de-at/servicesagreement#2_yourContent

Naja jedesmal wenn ich zu dem Handy-Reperaturshop meines Vertrauens gehe (und in der Familie fallen immer wieder Geräte mal runter und gehen zu Bruch wo ich nicht einsehe jedesmal neue zu kaufen) darf ich Zeuge von Dramen sein, die sich da abspielen. Wenn Menschen Ihr ganzes digitales Leben auf einem Gerät haben, das dann Ex geht. Nichts mit Cloud oder SD-Karte. Menschen wissen nicht einmal mehr was eine Datei ist und können mit einem Dateimanager was anfangen.

Ich verspüre bei sowas kein Mitleid mehr… wer nicht weiß, wie sein tägliches genutztes Handwerkszeug funktioniert, sich nicht um Backups kümmert., der verdient genau das und nichts anderes.

Oh, bitte… 🙃

"Der Schaden der von Aussagen wie deiner selbst in meinem Bekanntenkreis umgeht ist enorm ."

Welcher "Schaden"? 🙄

Es sagt ja niemand, dass sie generell auf DatenSICHERUNG verzichten sollen! 🤷♂️

Wenn besagt unbedarfte "Benutzer" aus WOHLSTANDSBEQUEMLICHKEIT darauf verzichten sich zu informieren bzw. um und mit alternativen Möglichkeiten zu beschäftigen, haben sie echt SELBST Schuld! 🤨

Obwohl ich grundsätzlich nichts von dieser absolutistischen "Verurteilung" halte, aber aus gesellschaftlicher Selbstverständlichkeit fiele wohl auch kaum jemandem ein seine Wohnungs-/Haustür bei Abwesenheit offen und/oder unverschlossen für unerwünschten "Besuch" zu lassen, um jedem unkontrollierten Zugang zu privaten Printdokumenten zu ermöglichen – für die sieht man doch auch in gewissem Rahmen "Schutz" vor.

Und 'n (USB-)Speicher"gerät" für Datensicherung ist weder schwer zu bedienen noch übermäßig teuer – da wird an anderen Stellen viel unbedachter ganz anderes Geld "investiert", gell?! 🧐

Und dann identifiziert irgendeine Microsoft oder Apple oder Google KI irgendeines Deiner Urlaubsbilder als unerwünscht und sperrt Deinen Account nachhaltig und Du kannst mit Chatbots reden bis zum St. Nimmerleinstag. Deine Daten sind dann zwar nicht weg, aber nicht mehr für Dich zugänglich. Ist das "sicher"?

Ich kenne diese Geschichten.

Ich kenne aber niemanden der jemanden kennt der jemanden kennt dem sowas schonmal passiert ist.

Ich kenne aber viele, denen ihr Telefon in die Toilette gefallen ist , und alle Daten verloren waren.

Google z.b. hat über 1 Milliarde Nutzer. Selbst wenn es jeden 10000 treffen sollte , müsste es 100000e Falle geben.

Tut es aber nicht.

Natürlich als Firma wie auch privat , ist ein Backup immer sinnvoll. Wenn auch rein statistisch die Daten bei Google & Co deutlich sicherer aufgehoben sind wie ohne Sicherung und ohne sync in die Cloud.

Lies mal die AGB von den Clouddiensten!

Z.B. bei Microsoft gewährt man Microsoft das Nutzungsrecht an den hochgeladenen Inhalten.

Lädt man da z.B. ein Bild hoch, dann darf Microsoft das Bild für eigene Zwecke (z.B. Werbung) benutzen!

Man sollte also die AGB der entsprechenden Clouddienste sehr sehr genau lesen, bevor man die nutzt.

So viele Behauptungen die halt einfach nicht stimmen. 5 Sekunden in einer Suchmaschine hätten gereicht.

https://www.microsoft.com/de-at/servicesagreement#2_yourContent

Dir ist schon der Unterschied zwischen Eigentum und Besitz klar? Und lesen solltest Du Deinen verlinkten Link vielleicht auch. Denn auch wenn die Inhalte in Deinem Eigentum bleiben gewährst Du leider jedem anderen (inkl. Microsoft) uneingeschränkte, weltweite Nutzungsrechte, die z.B. ein Füttern einer KI oder Nutzung in Dir vällig unbekannten Zwecken beinhalten.

Ganz besonders schlimm wird es, wenn gewerbliche Nutzung mit im Spiel ist. Denn diese wird für einige MS Produkte in der EULA sogar explizit ausgeschlossen. Warum? Weil MS ganz genau weiß, dass diese in gefährliches Fahrwasser kommen würden, wenn Sie diese Nutzung nicht ausschliessen würden.

https://blog.jakobs.systems/blog/20210529-windows-gewerblich/

Autsch.

Dir ist schon klar, dass Hinweise zur Gewerblichen Nutzung, auch bei meinem Mixer, Backofen , Popcorn Maschine stehen… oder Mietobjekten.

Das hat viele einfache Gründe. Z.b. Reinigung, Nutzungsdauer, usw. usw. Und ist bei Software nicht anders.

Vielleicht solltest du dich Mal von einem Juristen beraten lassen.

Ich lade mal ein Foto von Herrn Born hoch

Die Idee ist gut. 😀

Ich hab's mal gemacht. Ergebnis der Persönlichkeitsanalyse:

"Finanziell stabil, Potenzial für hochpreisige Einkäufe, empfänglich für gezielte Werbung für professionelle Dienstleistungen und Luxusgüter."

Völlig korrekte Einschätzung, oder? 😉

Hier gibt es noch Beispiele die eine Futurezone Autorin mit ihren eigenen Bildern machen hat lassen.

https://futurezone.at/produkte/tool-theyseeyourphotos-google-vision-ki-fotos-interpretation-alter-emotionen-einkommen/402994319

Im Gegensatz zu Florence von MS, dürfte die Google KI sehr auf die Analyse von (Geld-)Wert bzw. der Einkommensklasse trainiert sein. Warum das für Google wichtig ist, das kann man nur spekulieren…

Anhand welcher Vorurteile wird den Fotoobjekten eine „Religion" zugeordnet? Weil die Frau kein Kopftuch trägt und Trump keinen Turban? Oder weil sie drei Kinder haben? Mit solchen Ratereien mag Google im Bible Belt einigermaßen treffsicher sein, aber im säkularen Europa liegt die KI mal wieder krass daneben – ohne dass es sie davon abhalten würde, daraus immer weitere Schlüsse und Konsequenzen zu ziehen.

Solange Firmen, Politik und Medien solche "Nicht-KI" weiter ohne Rücksicht auf irgendwas promoten und sich kaum einer wehrt, wird alles, was solche "Nicht-KI" sagen, demnächst als unfehlbare Wahrheit von der dumpfen Masse akzeptiert werden.

Dafür ist der ganze Hype auch gedacht. Dass sämtliche Dinge einfach nicht mehr in Frage gestellt werden. Sondern der grossen, heiligen KI (die von den Machern im Hintergrund natürlich eliebig manipuliert werden kann und wird) alle Bereiche des Lebens anvertraut wird, von Ernährung über Diagnosen bei Krankheit bis hin zu Vorgaben für CO2 Sparmassnahmen und in der finalen Ausprägung dann am Ende auch Lebenszeitbegrenzung.

Ja ist mir auch schleierhaft…. ;)

Ich denke Google trainiert hier mit anderen Daten als die anderen Bild Analysen. Hier scheint man schon bekannte Profile von Usern mit deren Bildern für das Training verknüpft zu haben, um solche Analyseergebnisse zu bekommen. Auch die Gehaltsklassen etc.

Solche Klassifizierungen gibt es bei den anderen Modellen meines Wissens nicht, aber vielleicht auch nur nicht in den offenen Modellen (aber in den internen dann schon..)

Natürlich stimmt so etwas nicht für ein Foto. Bei vielen Fotos ergibt sich eventuell dann ein größeres Bild, zB bei Festtagen (Weihnachten etc), in Kombination mit all den anderen Daten die gesammelt werden, ist es dann schon beängstigend.

Vollkommen richtig, dass diese Trainingsdaten nicht frei auf andere "Gegenden" "Kulturen" übertragbar sind, umso gefährlicher wenn sie dann so verwendet werden und wie sie geschrieben haben – welche Konsequenzen das dann für den/die einzelne(n) hat.

Was ist denn mit Datum, Uhrzeit und Standort, die doch mindestens in den allermeisten Fotos gespeichert werden … sofern man das nicht explizit abgeschaltet hat. Seltsam, das diese Daten nicht genannt werden, zumal eine "Profi-Kamera" erkannt wurde.

Ist jetzt meine Vermutung, aber es geht hier vermutlich nur um die KI Analyse. Metadaten können dann noch extra von Google analysiert werden. Die Profi-Kamera wird vermutlich auch mit der LLM Analyse erkannt, weil es viele Trainingsdaten mit Profikameras gibt, die ähnliche Bildeigenschaften haben – schließt dann das Netz daraus – das Bild wurde auch mit einer Profikamera gemacht. Muss natürlich nicht stimmen – ist ja nur Statistik.

Umgekehrt kann man diese Analyse dann in einen Bildgenerator wieder eingeben, und es werden "ähnliche" Bilder erzeugt. Das finde ich dann wieder echt spannend – erschreckend – genial – und alles auf einmal.