Google hat gerade angekündigt, dass sein Produkt "Google Lens", welches z.B. in der Kamera-App von Google unter Android mit dabei (aber auch unter iOS verfügbar) ist, um eine verschiedene Funktionen ergänzt wurde. Eine Funktion ermöglicht die Analyse von Bildern der Haut – um dort Anomalitäten, die eine Abklärung durch einen Arzt nahelegen, zu erkennen.

Google hat gerade angekündigt, dass sein Produkt "Google Lens", welches z.B. in der Kamera-App von Google unter Android mit dabei (aber auch unter iOS verfügbar) ist, um eine verschiedene Funktionen ergänzt wurde. Eine Funktion ermöglicht die Analyse von Bildern der Haut – um dort Anomalitäten, die eine Abklärung durch einen Arzt nahelegen, zu erkennen.

Die Ankündigung erfolgte bereits am 14. Juni 2023 im Google-Blog im Rahmen des Beitrags 8 ways Google Lens can help make your life easier. Dort stellt Google acht neue Funktionen vor, die Google Lens künftig beherrschen soll. Das reicht von Erklärungen zu Objekten, die man gerade sieht (und fotografiert) über die Übersetzung von Verkehrszeichen in über 100 Sprachen bis hin zu verschiedenen Bildanalysen. Man soll nach dem suchen können, was die Kamera sieht, heißt es.

Hautanalyse mit Google Lens

Eine dieser Funktionen ist dabei die Analyse von Fotos der Haut auf Anomalitäten. Google schreibt dazu folgendes:

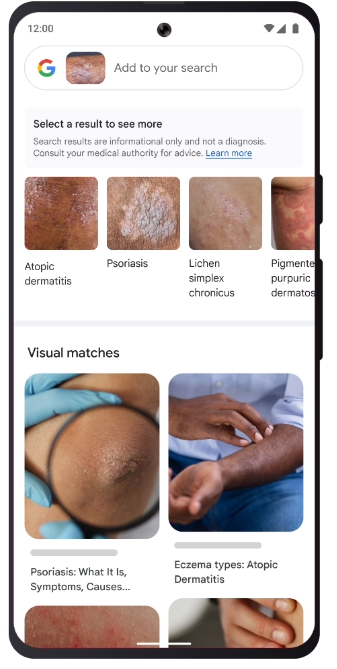

Diese neue Funktion von Google Lens sucht nach Hautkrankheiten, die dem, was Sie auf Ihrer Haut sehen, visuell ähnlich sind. Sie können den betroffenen Bereich ausschneiden, während die Ergebnisse in einem Karussell über "Visuelle Übereinstimmungen" angezeigt werden.

Das Unternehmen weist darauf hin, dass "die Suchergebnisse nur zur Information dienen und keine Diagnose darstellen. Wenden Sie sich für eine Beratung an Ihren Arzt." Neben Fotos der Haut funktioniert die Funktion auch bei "Bläschen auf der Lippe, einer Linie auf den Nägeln oder Haarausfall auf dem Kopf". Google gibt an, dass es diese Funktion entwickelt hat, weil "die Beschreibung eines seltsamen Leberflecks oder Ausschlags auf der Haut mit Worten allein schwer zu bewerkstelligen ist."

Die Funktion soll helfen, dass Leute Hautveränderungen mittels Google Lens "irgendwie analysieren" können. Ermöglicht wird dies durch Googles Funktion zur "Bildersuche", die ähnliche Bilder erkennen und anzeigen kann. Dies wird auch an weiteren, im oben erwähnten Beitrag vorgestellten Funktionen (wie Shopping eines Gegenstands, den man gesehen hat) deutlich.

Die Funktionen von Google Lens haben aber gleich mehrere Problemstellen. Einmal werden die Bilder zur Analyse an Google Server übertragen – dort analysiert eine KI-Software dann die Bilder. Wird halt nicht jeder wünschen. Das größere Problem sehe ich aber in der Frage: Wie zuverlässig ist das Ganze. Wenn die KI hinter Google Lens bei einem Foto der Hautstelle nichts meldet, heißt das nicht "da ist nichts". Und ein Treffer in einer Bilddatenbank muss nicht bedeuten, dass es Hautkrebs ist. Letztendlich wird nur ein Arzt (Dermatologe) die Hautveränderung nach einer Untersuchung beurteilen können. Hautkrebsvorsorge bleibt also wichtig. Andererseits gibt es die Hoffnung, dass Menschen, die nicht zur Vorsorge gehen, mit der Funktion in Google Lens vielleicht auf Anomalitäten hingewiesen werden können und dann das von einem Arzt abklären lassen.

MVP: 2013 – 2016

MVP: 2013 – 2016

Und die Bilder bleiben ganz sicher auf dem eigenen Smartphone? Oder landen die dann in der Cloud und man weiß nicht wer sie noch zu sehen oder angeboten bekommt?

Private Krankenversicherungen und Arbeitgeber werden sich freuen.

vielleicht mal den Text lesen und nicht nur die Überschrift…ist das soooo Schwer??

Wird die Ärzte "wahnsinnig freuen" …! Noch mehr Patienten, die Dr. Google dann mehr vertrauen, als dem menschlichen Arzt.

O-Ton meiner Hausärztin vor einiger Zeit: "Am liebsten würde ich Dr. Google erschlagen, da inzwischen fast jeder zweite mit einer "klaren, vorgefertigten Analyse" hier aufschlägt, und sich von diesen Menschen dann rund ein Drittel fast nicht mehr von ihrer "perfekten" Internet-Analyse abbringen lassen. Hinzu kommen noch diverse "Medizinforen", in denen sich die Patienten dann auch noch gegenseitig in ihren "medizinischen Erkenntnissen" bestätigen! Die "richtige" Medikamentierung natürlich auch gleich mit eingeschlossen … Dr. Google ist einfach ein beschissener Arzt, der für jede Krankheit (auch wenn es oft gar keine ist …) das Ultimative vorhält: Nämlich von "du hast gar nix" bis "du hast nur noch wenige Stunden zu leben!" Entsprechend verunsichert und verstört, bis hysterisch sind die Patienten dann oftmals auch …"

Und vom Thema Datenschutz brauchen wir gleich mal wieder gar nicht zu reden … Aber interessiert ja eh so gut wie keinen (mehr) – sofern es je überhaupt die Mehrheit interessiert hat(te) …

Ich bin kein Freund von Google, aber in diesem Fall finde ich die Reaktion von den Vorpostern hier etwas überzogen.

Mit Hautkrebs ist nicht zu Spaßen und eine Früherkennung essentiell wichtig.

Lieber ein paar mal zu viel zum Hautarzt als 1x zu wenig.

Wenn Google Benutzer dazu animiert, ist das – in diesem Fall – zu befürworten.

https://www.zdf.de/nachrichten/panorama/hautkrebs-zunahme-krankenhaus-behandlungen-100.html

https://www.krebshilfe.de/informieren/ueber-krebs/krebsvorsorge-und-krebsfrueherkennung/hautkrebsscreening/

PS: Ich musste mir auch schon ein auffälliges Muttermal (noch gutmütig) entfernen lassen.

In der Medizin streitet man sich über den Sinn mancher Vorsorge-Untersuchungen und führt Studien durch, ob und ab wann was sinnvoll ist und was nur unnötig Ängste schürt. Aber Google wirft mal eben die nächste Hypochonder-App aus: Künstliche Intelligenz, die erstmal alles sammelt, was man ihr zur Begutachtung vorlegt und daraus – nach und nach – „lernt", vorher aber noch reichlich Fehldiagnosen absondert. Toll, wenn dann gleich noch passende Schockbilder mitserviert werden.

Hat die App dann auch gleich eine Facharzttermin-Funktion oder müssen Betroffenen mit ihrer Schreckensdiagnose weiterhin selbst herumtelefonieren, um einen Praxistermin drei, vier Monate später zu ergattern?

Der erste Gedanke nach Lektüre des Artikels war: Was soll das? Wenn man eine verdächtige Hautveränderung wahrnimmt, sollte man gleich einen Arzt konsultieren und nicht erst Google Lens bemühen. Der zweite Gedanke war: Das ist ein typisch westeuropäischer Blick. Bei uns sind alle Menschen krankenversichert, es gibt ein flächendeckendes Gesundheitssystem, wenn man ein gravierendes medizinisches Problem vermutet, kann man quasi jederzeit medizinische Leistungen in Anspruch nehmen, ohne sich darüber Gedanken machen zu müssen: Kann ich das bezahlen?

Das ist in vielen Regionen der Welt anders. Selbst in den USA sind viele Menschen nicht krankenversichert. Armut ist in den USA ein Riesen-Problem. Und die Krankenversicherungen, die es gibt, funktionieren teilweise anders mit Selbstzahlergrenzen von mehreren tausend Dollar im Jahr – und erst wenn diese Grenze überschritten wird, springt die Krankenversicherung ein. Das heißt, die Frage „Kann und will ich eine medizinische Leistung bezahlen?" hat dort eine ganz andere Relevanz. Hinzu kommt, dass die medizinische Versorgung in ländlichen Regionen deutlich weniger engmaschig ist und weite Wege zu fahren sind. In so einem Umfeld hat eine (kostenlose) Hautscreening-App absolut ihre Berechtigung, ist jederzeit und überall verfügbar und kann eine Ersteinschätzung und Entscheidungshilfe bieten: Sollte ich einen Arzt konsultieren? – Immer vorausgesetzt, die Entwicklung einer solchen App (oder Google Lens-Funktion) wird wissenschaftlich begleitet und evaluiert. Alles andere wäre unethisch und verantwortungslos.