Das Thema Cybersicherheit hat viele Administratoren bereits 2025 in Trab gehalten – Sicherheitslücken bedrohen IT-Landschaften im Hinblick auf Cyberangriffe. Aber im Zweifelsfall reichen einfache Phishing-Ansätze. Und mit dem KI-Hype verändern sich nochmals die Spielregeln, weil neue Sicherheitsrisiken in die Unternehmen einziehen.

Das Thema Cybersicherheit hat viele Administratoren bereits 2025 in Trab gehalten – Sicherheitslücken bedrohen IT-Landschaften im Hinblick auf Cyberangriffe. Aber im Zweifelsfall reichen einfache Phishing-Ansätze. Und mit dem KI-Hype verändern sich nochmals die Spielregeln, weil neue Sicherheitsrisiken in die Unternehmen einziehen.

Das Thema ist nicht ganz neu, hatte ich hier im Blog doch in zahlreichen Blog-Beiträgen gewarnt. Viele Unternehmen treiben den Einsatz von KI voran, in der (oft trügerischen) Hoffnung, dadurch effizienter und produktiver zu werden. Dabei werden die (aus Security-Sicht) Schattenseiten des KI-Einsatzes ausgeblendet.

So ist mir erst kürzlich der Beitrag Microsoft Wants AI Agents in Your PC Despite Warning They Could Install Malware untergekommen. Microsoft drückt KI-Agenten in seine Produkte rein, kostes es (Sicherheit) was es wolle.

Der Sicherheitsspezialist Forcepoint hat bereits vor einigen Tagen einen Blick darauf geworfen, welche Risiken sich aus dem wachsenden KI-Einsatz in Unternehmen in den kommenden Monaten und Jahren ergeben. Nach Einschätzung von Forcepoint müssen sich Unternehmen im neuen Jahr mit den folgenden Entwicklungen auseinandersetzen:

Cyberkriminelle füttern KI-Tools mit unsichtbaren Prompts

Ich weiß nicht, wie oft ich hier im Blog vor der Infiltierung von KI-Abfragen und Tools durch injizierte Prompts und den einhergehenden Risiken gewarnt habe. Forcepoint schreibt, dass es in den vergangenen Jahren zahlreiche Angriffe gab, die auf eine ClickFix genannte Methode des Social Engineering setzten, um Anwender zur Ausführung von Befehlen und Malware zu verleiten. Dafür wurden präparierte Websites mit täuschend echt aussehenden Sicherheits- und Systemmeldungen genutzt, etwa dem Hinweis auf ein verfügbares Update oder auch ein vermeintliches Captcha.

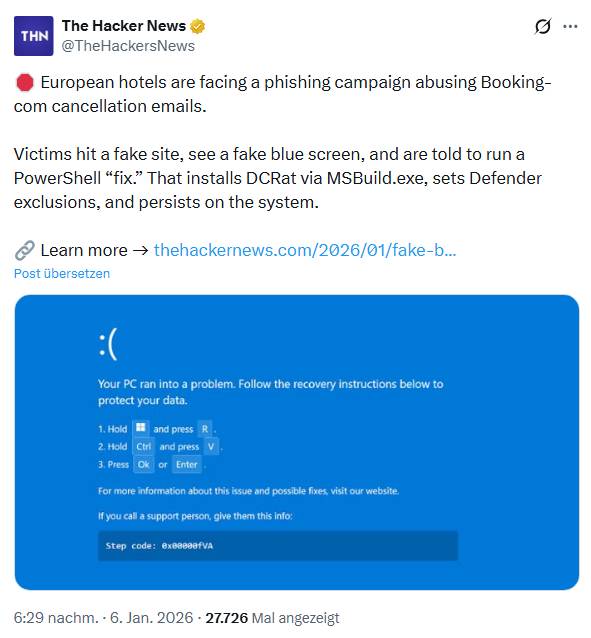

The Hacker News hatte in diesem Beitrag und die Kollegen von Bleeping-Computer hatten zum 5. Januar 2026 im Artikel ClickFix attack uses fake Windows BSOD screens to push malware genau vor einer solchen ClickFix-Angriffskampagne gewarnt. Gefälschte Buchungs-E-Mails leiten Hotelmitarbeiter auf gefälschte BSoD-Seiten weiter, wo dann die DCRat-Malware ausgeliefert wurde. Und aktuell gibt es den Artikel New ClickFix attacks abuse Windows App-V scripts to push malware bei Bleeping Computer.

Forcepoint schreibt, dass ClickFix-Angriffe in neueren Varianten nun nicht mehr die Anwender direkt ins Visier nimmt. Sondern die Angreifer zielen nun auf die KI-Tools, mit denen Nutzer beispielsweise Websites analysieren und zusammenfassen. Die Seiten enthalten für den Menschen nicht sichtbare Texte, unter anderem weiße Buchstaben auf weißem Hintergrund, die von Large Language Models wahrgenommen und als Prompt verstanden werden. Ihre Antworten enthalten dann Links auf manipulierte Websites oder ausführbaren Code.

Ganz ohne Mithilfe der Anwender gelingt es ClickFix zwar auch weiterhin nicht, Systeme zu infizieren, doch die Chancen steigen, da viele Nutzer der KI vertrauen und die Ausgaben nicht infrage stellen. Künftig könnte der Anteil der notwendigen menschlichen Interaktionen zudem noch sinken, denn die Masche ist recht neu und wird sicher weiterentwickelt.

Dafür spricht auch, dass die entsprechenden Domains und Seiten bislang eher kurzlebig waren und vor allem dazu dienten herauszufinden, wie KI die unsichtbaren Prompts verarbeitet und wie sich Schutzmechanismen umgehen lassen.

Technische Schulden durch KI sind ein wachsendes Risiko

Der Wunsch mancher Entscheider in Firmen, neue KI-Tools zügig einzuführen und neue Datenquellen rasch für KI zugänglich zu machen, führt häufig zu überstürzten Integrationen, der Nutzung veralteter Konnektoren, unsicheren Daten-Pipelines und dem Aufschub wichtiger Entscheidungen zu den eingesetzten IT-Architekturen, hat Forcepoint beobachtet.

Damit wächst die Angriffsfläche von Unternehmen unmerklich, während zugleich die Sichtbarkeit innerhalb der Datenlandschaft schwindet. Ich hatte ja bereits im Blog-Beitrag Technische Hypotheken: Muss die KI-Revolution ausfallen? – Teil 2 von technischen Hypotheken gesprochen, die sich Unternehmen mit dieser (meist nicht verstandenen) Technologie ins Haus holen.

Forcepoint argumentiert, dass diese technischen Schulden nicht selten erst dann offenbart werden, wenn es zu einem Sicherheitsvorfall oder einem Datenabfluss kommt. Letztlich stehen die Prozesse für Data Discovery, Data Classification und Data Governance unter konstantem Druck, weil sich Datenquellen, Zugriffsmuster und Compliance-Anforderungen beim KI-Einsatz kontinuierlich verändern.

Traditionelle Security-Tools wie Firewalls, Endpoint-Schutz oder SIEM-Systeme (Security Information and Event Management) helfen laut den Sicherheitsexperten hier kaum weiter. Unternehmen benötigen Lösungen, die Data Discovery und Classification automatisieren, und das lückenlos über alle Datenquellen hinweg.

Darüber hinaus sollten Lösungen für Datensicherheit stets alle relevanten Konnektoren unterstützen, ungeschützte Daten und weitreichende Zugriffsberechtigungen aufspüren, für eine restriktive Rechtevergabe nach dem Least-Privilege-Prinzip sorgen und ein Echtzeit-Monitoring bieten.

Agentic AI vergrößert die Angriffsfläche

Agentenbasierte KI ist ein großes Hype-Thema, das Marketing verspricht den Entscheidern in Unternehmen einen bislang ungekannten Grad der Automatisierung. Statt einzelner Agenten, die klar definierte Aufgaben übernehmen, kümmert sich eine ganze Schar aus Agenten um komplexe Probleme. Sie stimmen sich untereinander ab, suchen und planen Lösungswege, fällen Entscheidungen und handeln weitgehend autonom.

Auf Hochglanzfolien sieht es super aus. Im Grunde verhalten sich diese KI-Bots wie Mitarbeiter – nur mit dem Malus, ohne die Intuition, den ethischen Kompass und das Verständnis von Kontext eines menschlichen Mitarbeiters auskommen zu müssen.

Damit stellen KI-Bots klassische Security-Ansätze vor Herausforderungen. Einem einzigen Agenten sicherheitskonformes Verhalten beizubringen, ist schon nicht einfach, aber gleich mehreren, die Daten mit Höchstgeschwindigkeit aus unterschiedlichen Quellen ziehen, austauschen und verarbeiten?

Hier ergeben sich viele neue Angriffspunkte, weil Cyberkriminelle nicht unbedingt den Agenten manipulieren müssen, der eine finale Entscheidung fällt. Bisweilen reicht es, den ersten Agenten hinter dem Frontend auszutricksen, sodass er falsche Informationen oder Inhalte, in die schädliche Prompts eingebettet sind, an nachfolgende Agenten weiterreicht.

Letztlich brauchen Unternehmen dedizierte Spezialisten, die genau verstehen, wie Agentic AI arbeitet, entscheidet und kommuniziert, um die damit verbundenen Risiken zu minimieren, meint Forcepoint.

Dabei werden diese Mitarbeiter sicherlich die Unterstützung spezialisierter Agenten benötigen, denn Menschen können den Input und Output der agentenbasierten Systeme weder vom Umfang noch den zeitlichen Anforderungen her überprüfen.

Langfristig muss der KI aber sicherheitsbewusstes Verhalten antrainiert werden, also das Verständnis für Richtlinien, ein Bewusstsein für riskante Entscheidungen und die Fähigkeit, im richtigen Moment einen Menschen oder einen Security-Agenten hinzuzuziehen.

Infrastruktur der KI-Automatisierung erfordert Vorarbeit

IT-Teams stehen unter konstantem Druck, schneller zu werden, etwa beim Bereitstellen neuer Systeme, beim Einspielen von Patches oder beim Lösen von IT-Problemen. Automatisierung ist das Gebot der Stunde, und KI kann hier ein wertvoller Helfer sein. Doch die hastige Einführung kann zu instabilen Systemen, Ausfällen und technischen Schulden führen, beobachten die Spezialisten von Forcepoint. Wer mehr automatisieren will, muss dafür erst die Grundlagen schaffen.

- Dazu zählt ein tiefgehendes Verständnis der Systeme und ihrer Abhängigkeiten sowie der Abläufe bei der Verwaltung und beim Troubleshooting, denn nur so lassen sich tragfähige Konzepte für Fehlersuche, Anpassungen und mögliche Rollbacks entwickeln.

- Darüber hinaus sollten die Personen, die am nächsten an den Systemen sind, die Freiheit haben, Probleme selbst zu untersuchen und einfache Fehler selbst zu beheben – ohne zusätzliche Eskalation. Eine solche kostet oft wertvolle Minuten und sollte komplizierten Fällen vorbehalten sein.

- Und schließlich braucht es ein modernes Monitoring, da sich mit einzelnen, nicht verbundenen Tools keine sinnvollen Automatismen, etwa für Failover, einrichten lassen.

Auf dieser Basis kann dann auch KI laut Forcepoint sehr gut , etwa beim Clustern und Priorisieren von Alerts oder bei der Prognose von Lasten und der vorausschauenden Planung von Kapazitäten, unterstützen. Künftig könnte KI zudem vergangene Vorfälle und Konfigurationsunterschiede analysieren, um Risikobewertungen, Testszenarien oder Optimierungen vorzuschlagen. Mit digitalen Zwillingen ließen sich zudem größere Änderungen innerhalb der Infrastruktur sicher ausprobieren, bevor sie in der Produktivumgebung ausgerollt werden.

"KI ist äußerst vielseitig und leistungsstark, bietet Cyberkriminellen aber auch neue Angriffspunkte und stellt IT-Teams vor Herausforderungen", betont Fabian Glöser, Manager Sales Engineering bei Forcepoint in München. "Unternehmen sollten den Einsatz daher nicht überstürzt vorantreiben, sondern zunächst Risiken identifizieren, bewerten und eindämmen, um das fraglos disruptive Potenzial möglichst sicher zu erschließen."

MVP: 2013 – 2016

MVP: 2013 – 2016

Ehm…. kann ich nicht bestätigen. Wer von sowas betroffen ist, hat eindeutig seine Hausaufgaben nicht gemacht.

Normale Anwender haben in allen von mir aufgebauten oder betreuten Netzen genau kein Recht, unbekannte Software oder Skripte zu starten (SRP/AppLocker). Zusätzlich sind die Systeme offline und Internet lediglich via Proxy auf den Firefox bechränkt. Selbst wenn SRP failen sollte, kann keine ausgeführte Software oder das System selbst irgendwas "nach Hause" senden oder von außen Befehle erhalten.

https://blog.jakobs.systems/blog/20251005-ntlm-ad-offline/

https://blog.jakobs.systems/blog/20240506-service-tips-windows/

Es geht hier nicht um Programme starten. KI findet noch meistens im Browser statt, und es ist in der EU verboten, den Leuten beim Prompten über die Schultern zu gucken. Man muss sich erstmal anschauen, was "Forcepoint" einem da verkaufen will, und das geht aber durchaus datenschutzkonform. KI-Prompts sind da nur ein Teilproblem, aber mit dem Buzzwort kann man momentan prima Interesse erwecken.

Man muss das Thema "DSPM" (Data Security Posture Management) erstmal durchdringen. Es geht hierbei darum, zu verstehen, wer welche Dateien im Zugriff hat, wer was damit macht, wer zu viele Rechte hat (und Daten öffnen kann, die er garnicht braucht – der noch schlimmer – nicht sehen können soll), generell ungewöhnliche Dateizugriffe , evtl. sogar aus einer (Geo-)Lokation von wo er noch nie zugeriffen hat, und wer was davon extern teilt, z.B. über Onedrive ("hat unseren Quellcode per OneDrive an x.ypsioln(at)mitbewerberfirma.de freigegeben"), LLM, Upload in externe Webserver und co.(hat innerhalb von 5 Minuten 725 Tabellen mit Kundenbankverbindungen geöffnet und anschließend gabs einen Upload auf Google-Drive"). Letztlich geht es hier um Data Loss Prevention (z.B. Insiderangriffe) und Erkennung/Verhinderung von Ransomware. Die Ransomware-Funktion könnte sich aber auch in einem Excel-Makro, Fileless-Powershell-Script oder einem Browseraddon verstecken, was du mit Applocker nicht verhindern kannst. Applocker hilft dir bei den Angriffsszenarien genau garnichts.

Forcepoint ist im DSPM Umfeld ein recht neuer Anbieter, der gerade viel Marketing über solche Artikel wie den hier macht, um von Platz 22 des Gartner-Rankings für DSPM aufzusteigen, der sich aber fast ausschließlich auf Cloud-Monitoring spezialisiert hat. Dabei dürfte hier borncity eine der wenigen Plattformen überhaupt sein, die das Thema aufgreift, höchstens noch die *-insider-Blogs von Vogel (Chip) noch und eine Randnotiz bei IX. Aber hier wird das thematisiert, ohne das Groß-Thema DSPM überhaupt mal zu beleuchten, einfach nur ein Happen, der neugierig machen soll, und den Leser dazu bewegen könnte, bei Forcepoint mal nachzuschauen, was die überhaupt machen. Denn das Problem ist, das DSPM-Thema ist noch nicht so verstanden, was man auch hier im Blog sieht. Die wahren Schwergeschichte der Branche sind Securiti, Sentra und Varonis. Cyera und Wiz sind weitere recht (un)bekannte Anbieterm und sogar IBM hat etwas. Varonis ist der älteste Anbieter in dem Feld und der erfahrenste und einer der wenigeren, der auch Onprem-Umgebungen (AD, Fileserver, Exchange, Storage, VPN,…) richtig gut abdeckt (AD-Auditing z.B. fast genauso gut wie Spezialisten wie Netwrix), die meisten anderen/jüngeren haben einen starken Focus auf Cloud. Insbesondere beim Data-Labeling ist Varonis der beste Anbieter (onPrem und Cloud), und das ist wichtig, du kannst nämlich nur das schützen, wo du weißt, dass es existiert. Das manuell zu finden, dafür hast du aber nicht die Zeit. Mit so einem DSPM-Monitoring ist das aber eine Sache von Sekunden, z.B. alle Dateien mit Klartextpasswörtern, Bankdaten, usw. zu finden – und viel wichtiger, zu wissen, wer darauf zugreifen kann, es aber nicht braucht. Ein relativ neuer und starker Anbieter ist Microsoft selbst, bei Unternehmen MS E5 Lizenzen ist Purview DLP/Labeling und Defender für den M365 Tenant schon drin, was viele zusätzliche DSPM-Anbieter eher überflüssig macht – OnPrem kann Purview und bei fremden KI/Cloud Anbietern aber genau garnix. Und viele größere Firmen haben E5, wissen aber mit Purview aber genau nichts anzufangen. Nur die, die wie Varonis Hybrid-Umgebungen, also auch lokales AD, Storage, Sharepoint und Netzwerkkomponenten mit überwachen, und sogar Google-Docs, AMazon AWS/S3 mit einbinen können, ergeben dann zusätzlich noch Sinn, weil sie quasi auf Purview mächtig noch oben was drauf setzen und auch ohne M365-Tanant funktionieren, und nicht nur das, Varonis konfiguriert einem dann sogar noch Purview sinnvoll mit, falls das bisher noch nicht getan wurde…

Herr Born, wäre das nicht mal was für Sie? Richtig gut erklären, was DSPM ist, welchen Nutzen das hat, wer sowas brauchen kann, und vielleicht wo die Stärken/Schwächen der Anbieter sind? Letzteres könnte schwierig werden, aber die ersten drei Teile wären schonmal ein Anfang. Und manche Anbieter unterstützen hier sogar die Überwachung von Linux-Ressourcen, das dürfte dann auch für einen weiteren Teil der Leserschaft interessant sein. Witzig finde ich die Übersicht bei Forcepoint selbst, wer der beste DSPM Anbieter ist, natürlich loben sie sich da selbst über den grünen Klee, aber die Darstellung der anderen Anbieter ist schlicht falsch. Vielleicht lässt sich so ein Artikel sogar an Heise oder Golem "verkaufen", um die Rente weiter aufzubessern?

Es gibt noch nicht mal einen Wikipedia-Artikel zu "Data Security Posture Management", traurig. Hier ist aber eine brauchbare kurze Übersicht zu dem Thema, falls meine Zusammenfassung nicht reichen sollte: https://www.gitwiki.org/the-power-of-data-security-posture-management/

Ich gebe euch mal einen Prompt, den ihr bei verschiedenen KI-LLMs einfügen könnt, um mal "neutral" zu sehen, was dabei raus kommt:

"Ich interessiere mich für DSPM. Ich habe ein Onprem-Active-Directory mit Fileservern, Exchange, Sharepoint, Citrix mit ADC, Storage, Hyper-V, einem guten Proxy und einen M365-Tenant. Evtl. soll noch Amazon AWS/S3 und/oder Google-Docs hinzukommen. Was gibt es da für Anbieter, die mir helfen, meine Daten abzusichern und zu schützen und bei Datenabfluss/Ransomware alarmieren und das schlimmste verhindern können? Wichtig sind mir Data-Labeleing und Analyse von Zugriffsmustern, um überhaupt zu wissen, was ich schützen muss und wo bereits schon etwas abfließt."

Die habe ich eben mal bei Copilot, Mistral, Gemini und ChatGPT eingefügt, und die Antworten sind sehr interessant.

Oh Boy Du hast Dir die verlinkten Berichte auch durchgelesen und verstanden? Du weisst, wie ClickFix funktioniert?

Doch, natürlich, aber man muss das Gesamtbild verstehen. Und das kann man nur, wenn man weiß, was Forcepoint macht. Du bekommst KI-Prompt-Schutz und Schutz vor KI-Datenabfluss nicht ohne DSPM. Und DSPM ist eben deutlich mehr als nur KI-Aktivitäten bewerten.

Das Interessante wird sein, wann und nicht ob negativ handelnde Kräfte, die KI-Geschichte den Bach runter gezogen haben. Denn die nicht bewusst Mitdenkenden werden es schaffen, allen nur möglichen negativen Leuten Tür und Tor zu öffnen, um anschließend festzustellen, dass sie das doch so gar nicht gewollt haben. Wobei ich absolut nichts gegen die Leute habe, die sich aktiv mit KI auseinandersetzen und es eventuell auch produktiv nutzen und sich auch über die Risiken bewusst sind.

"Letztlich brauchen Unternehmen dedizierte Spezialisten, die genau verstehen, wie Agentic AI arbeitet, entscheidet und kommuniziert, um die damit verbundenen Risiken zu minimieren, meint Forcepoint."

Öhm, wenn schon die Hersteller / Betreiber der KI nicht wirklich sagen können, warum etwas passiert, wo sollen denn dann bitte solche Spezialisten herkommen, die das angeblich können?

"Agentic AI" ist eben die nächste Runde bei all den "KI" Beratern, Agenturen usw., da kann man wieder neue Schulungen, Seminare, Tutorials usw. abrechnen.

War ehrlich gesagt auch mein Gedanke beim Lesen des Abschnitts…

Interessante Überlegung, aber das verschiedene Verhalten von verschiedenen Menschen auf bestimmte Situationen ist genauso wenig erklärbar. Das ist alles eine Sache der Prägung (Ausbildung, Kultur, Religion, Erlebnisse, persönliches Umfeld, Zeitabhängig, Situationsabhängig…).

Bei KI müssen wir uns damit abfinden, dass deren Entscheidungen genauso unvorhersehbar sind, wie bei Menschen.

Bei LLM "KI" ist die Entscheidung mathematisch anhand von Wahrscheinlichkeiten besser vorhersehbar als bei Menschen, ausser man dreht zu weit an der Temperatur, dann sind die LLM "KI" Entscheidungen weitaus willkürlicher als beim Menschen.

Bei kleinen Modellen mag das so sein, aber bei so großen Modellen wie Copilot, ChatGPT, Gemini und Co, die versuchen, alles Wissen der Welt aufzusaugen und miteinander zu kombinieren, endet deine Berechnung von Wahrscheinlichkeiten im Chaos, weil die Anzahl der Möglichkeiten hyperexponentiell steigt und das Trainingsmaterial minütlich anwächst. Das Ergebnis ist weniger vorhersehbar als ein fraktaler Algorythmus (z.B. Mandelbrod-Menge).

Manche Menschen sind sehr "berechenbar", aber nicht alle (siehe Trump), und weil man davon ausgeht, dass jemand immer "so" entschieden hat, muss das längst nicht bedeuten, dass er das nächste Mal auch "so" tut.

Die aktuelle LLM "KI" Copilot, ChatGPT, Gemini und Co. arbeiten genau so, mit Berechnung von Wahrscheinlichkeiten, nur justiert über die sog. Temperatur und massenhaft polit. Korrektheit Filter. Für viele ist das eine harte Erkenntnis, ja.