Es ist eine Entscheidung des AI-Anbieters Anthropic, die mir letztendlich Respekt abnötigt. Das Unternehmen widersetzte sich der Forderung des Pentagon (neuerdings US-Kriegsministerium), deren AI-Lösung für militärische Zwecke und Massenüberwachung freizugeben, und beugst sich nicht dem ausgesprochenen Ultimatum, obwohl ein 200 Millionen-US-Dollar-Vertrag auf dem Spiel stand. US-Präsident Trump hat nun die Nutzung von Anthrophic KI in US-Behörden verboten. Aber Google und OpenAI stützen die Anthropic-Position.

Es ist eine Entscheidung des AI-Anbieters Anthropic, die mir letztendlich Respekt abnötigt. Das Unternehmen widersetzte sich der Forderung des Pentagon (neuerdings US-Kriegsministerium), deren AI-Lösung für militärische Zwecke und Massenüberwachung freizugeben, und beugst sich nicht dem ausgesprochenen Ultimatum, obwohl ein 200 Millionen-US-Dollar-Vertrag auf dem Spiel stand. US-Präsident Trump hat nun die Nutzung von Anthrophic KI in US-Behörden verboten. Aber Google und OpenAI stützen die Anthropic-Position.

Das Ultimatum des Pentagon

Kleiner Rückblick: Ich hatte letztes Wochenende im Blog-Beitrag Sammlung von KI-Splittern und -Torheiten (Feb. 2026) bereits kurz über den Sachverhalt berichtet. Zum Sachverhalt nur so viel, dass Anthropic, die einen 200 Millionen US-Dollar schweren Vertrag mit dem US-Verteidigungsministerium haben, in den USA unter Druck geraten ist. Das US-Verteidigungsministerium (Pentagon, neuerdings als Kriegsministerium bezeichnet) hat dem Unternehmen ein Ultimatum gesetzt.

Verteidigungsminister Pete Hegseth fordert vom Unternehmen die Aufhebung der Sicherheitsvorkehrungen für sein KI-Modell im Hinblick auf die militärische Nutzung in Waffen sowie zur Massenüberwachung. Gerade letzteres ist in den USA wegen der Einsätze der Behörde ICE gegen Einwanderer stark umstritten (liefern doch Unternehmen wie Facebook, Palantir etc. Daten und Software an diese Behörde).

Im Artikel Pentagon threatens to make Anthropic a pariah if it refuses to drop AI guardrails beschreibt CNN, dass Verteidigunsminister Peter Hegseth damit droht, das Unternehmen auf eine Art schwarze Liste der Regierung zu setzen. Streitpunkt sind die Sicherheitsvorkehrungen, die Anthropic für sein KI-Modell Claude getroffen hat. Das Pentagon möchte, dass das Unternehmen seine Beschränkungen aufhebt, damit das Militär das Modell für "alle rechtmäßigen Zwecke" nutzen kann – was immer das heißt. Dem Unternehmen wurde bis zum heutigen Freitag, den 27. Februar 2026, ein Ultimatum gesetzt, sich den Forderungen zu beugen.

Anthropic hat jedoch Bedenken hinsichtlich zweier Themen, die es nicht bereit ist aufzugeben, so die in obigem Artikel zitierte Quelle: KI-gesteuerte Waffen und die massenhafte Überwachung amerikanischer Bürger im Inland. Laut einer mit der Angelegenheit vertrauten Quelle ist Anthropic der Ansicht, dass KI nicht zuverlässig genug ist, um Waffen zu bedienen, und dass es noch keine Gesetze oder Vorschriften gibt, die den Einsatz von KI bei der Massenüberwachung regeln. Das war mein Informationsstand von letztem Wochenende.

Anthropic bleibt standhaft

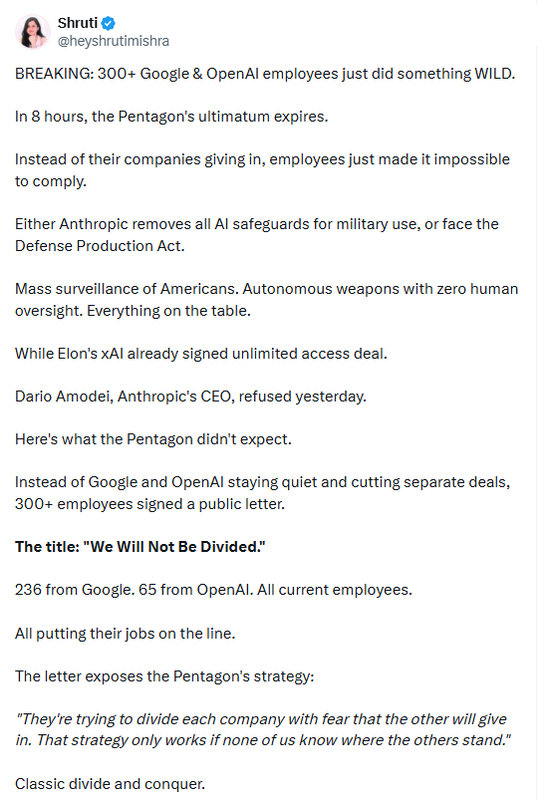

Anthropic ist den Forderungen des Pentagon nicht nachgekommen und hat die allgemeine KI-Freigabe nicht erteilt, wie ich vor wenigen Stunden hier nachgetragen habe. Mir war nachfolgender Tweet vom 26. Februar 2026 untergekommen.

Anthropic CEO Dario Amodei hat dazu diese Stellungnahme veröffentlicht. Er schreibt, dass diese Drohungen des Pentagon, Anthropic auf eine schwarze Liste zu setzen, "nichts an unserer Position" ändere. Man könne der Forderung, des US-Kriegsministeriums (der neue Name des Verteidigungsministeriums) nicht guten Gewissens nachkommen.

Er beschrieb die Bemühungen des Pentagons, ihn dazu zu zwingen, Claude für Massenüberwachung und autonome Tötungswaffen zu aktivieren. Darios Antwort darauf: Massenüberwachung ist nicht demokratisch und Claude sei nicht gut genug, um autonome Waffen zu ermöglichen. Man werde den Forderungen nicht nachgeben, der Regierung aber beim Wechsel zu einem neuen Anbieter helfen, wenn sie Anthropic auf die schwarze Liste setzt und von Aufträgen ausschließt.

Wie ich vor einigen Stunden gesehen habe, hat Golem die Weigerung von Anthropic in diesem Beitrag thematisiert. Ergänzung: Es gibt inzwischen ein zweites Anthropic-Statement vom 27. Februar 2026.

US-Präsident Trump verbannt Anthrophic AI-Lösungen

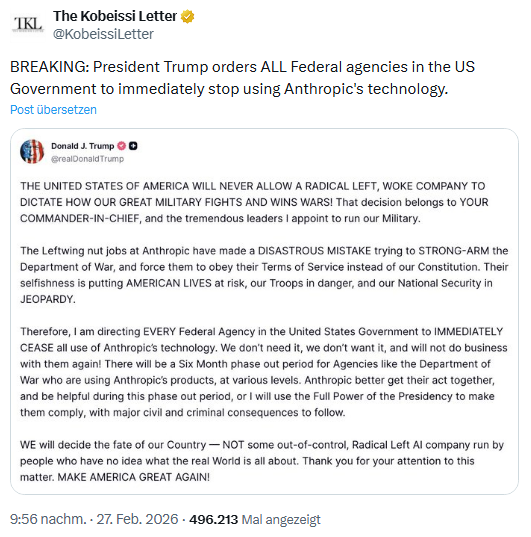

Nachdem das Ultimatum vor wenigen Stunden abgelaufen ist, und Anthropic sich nicht gebeugt hat, unternimmt die US-Regierung den nächsten Schritt. Mir ist gerade nachfolgender Post auf X untergekommen, nachdem US-Präsident Trump US-Regierungsangestellten die Verwendung von Anthropic Technologie untersagt.

Die Anweisung sieht eine sechsmonatige Auslaufphase für das Verteidigungsministerium vor und droht mit Konsequenzen, wenn das Unternehmen nicht beim Exit kooperiert (was der CEO aber im Vorfeld bereits zugesagt hat).

Der obige Ausriss eines Posts von Trump zeigt in meinen Augen, wie kaputt die US-Administration im Grunde ist. In diesem Artikel von Associated Press wird dies im Grunde auch reflektiert und bestätigt, dass AIx bereits in die "Lücke" gesprungen ist.

Die Washington Post skizziert in einem Artikel (Paywall), wie die Geschichte zwischen dem Pentagon und Anthropic eskalierte. Gizmodo hat es hier nachgezeichnet: Die Washington Post berichtet, dass das Pentagon angeblich ein Szenario mit einem Atomraketenangriff auf die USA vorgelegt habe, um auf manipulative Weise zu fragen, ob es sein KI-Modell zur Verteidigung des Landes einsetzen dürfe.

Anthropic-Chef Dario Amodei antwortete wohl sinngemäß, dass das Pentagon im konkreten Fall anrufen könne, man würde eine Lösung finden. Anthropic bestreitet diese Darstellung, aber die Leute im Pentagon waren wohl verärgert. Nun ist die Sache wohl eskaliert.

Das passt auch zum Tenor des aktuellen Golem-Beitrags US-Diplomaten sollen Datensouveränität bekämpfen. Dort geht es darum, dass Länder, und speziell Europa, sich von der US-Infrastruktur abkoppeln und digital souverän machen wollen. Das behindere die Entwicklung von KI-Dienste. Ich hatte dieses Thema bereits im August 2025 im Beitrag US-Administration unter Trump macht Druck auf EU wegen Digitalregeln aufgegriffen. Höchste Zeit, dass Europa digital souverän wird.

Im Moment sieht es für mich so aus, als ob dies einen riesigen Werbeeffekt für Anthropic haben könnte und der "Schuss für Trump nach hinten los geht". Vor dem Firmengebäude von Anthropic ist die Straße voll mit Solidatitätsbekundungen für das Unternehmen bemalt. Und längerfristig könnte es dem AI-Anbieter in die Karten spielen, speziell, wenn die politische Stimmung und Ausrichtung in den USA kippt.

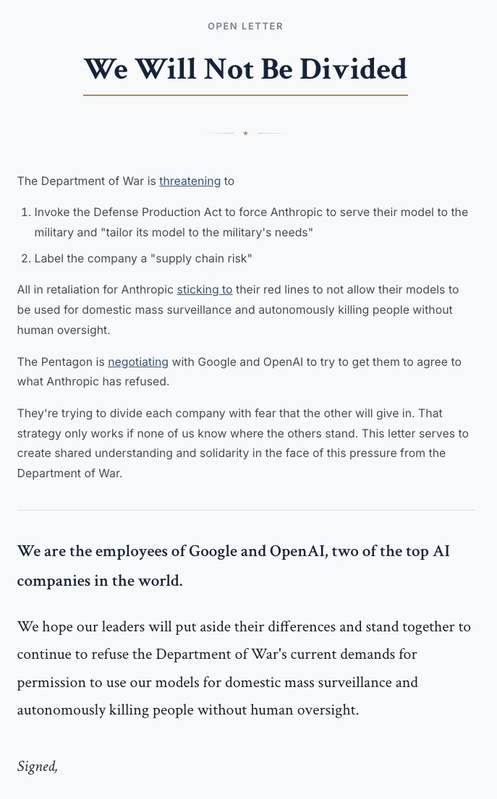

Google und OpenAI wollen nicht in die Lücke springen

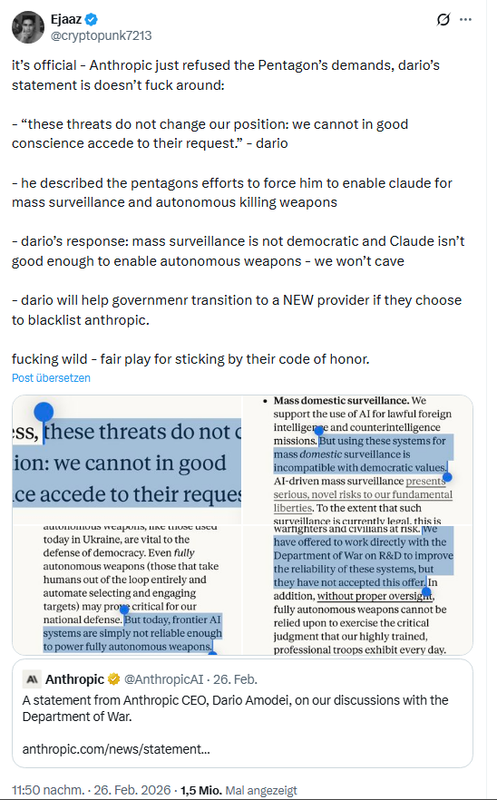

Es gibt aktuell eine extrem spannende Entwicklung. Normalerweise wäre man ja gewöhnt, dass der Mitbewerb freudig in die Lücke springt. Elon Musks AIx hat dies wohl getan. Aber wenige Stunden vor Ablauf des Pentagon-Ultimatums haben sich mehr als 300 Angestellte von Google und OpenAI in einem offenen Brief mit dem Titel "We Will Not Be Divided" zu Wort gemeldet.

Obiger Screenshot zeigt diesen offenen Brief. Die Leute erheben öffentlich ihre Stimme und fordern ihre Unternehmensführung auf, sich nicht von der US-Regierung gegen Anthropic ausspielen zu lassen. Ich bin über nachfolgenden Tweet darauf aufmerksam geworden. Engadget hat es in diesem Artikel ebenfalls aufgegriffen.

Im Jahr 2018 haben Google-Mitarbeiter öffentlich gegen das Projekt Maven (KI für Drohnenzielerfassung) protestiert. Seinerzeit stieg Google aus dem Projekt aus und versprach, KI nicht in Waffen einzusetzen.

OpenAI springt doch in "Lücke"

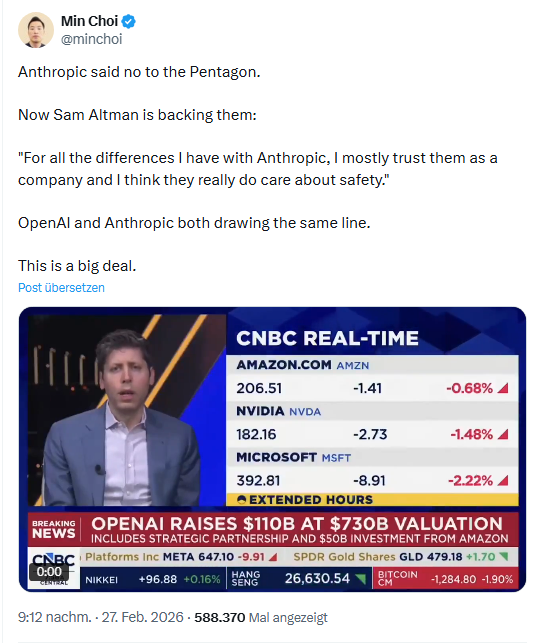

Ergänzung: Es sieht gemäß obigem Tweet so aus, als ob OpenAI-CEO Sam Altman die Position von Anthropic unterstützt. Ergänzung: Bin da rechts überholt worden, wie aus dem Kommentar von Bolko hervorgeht. Bei heise hat man die Kernpunkte zusammengefasst: Das Unternehmen hält die KI-Lösungen nicht für den Einsatz in Waffen für geeignet – es gibt da ein Interview des CEO auf Youtube, in dem er die Vorwürfe des Pentagon zurückweist. Man wolle weder US-Bürger noch US-Soldaten durch Anthropic-KI gefährden. Ein Beispiel wurde durch den Abschuss einer Drohne gerade eindrücklich bestätigt (siehe den heise-Bericht "Resultat von Inkompetenz": US-Militär schießt Drohne der US-Grenzpolizei ab). Zudem lehnt Anthropic den Einsatz seiner KI zur Massenüberwachung von Amerikanern ab.

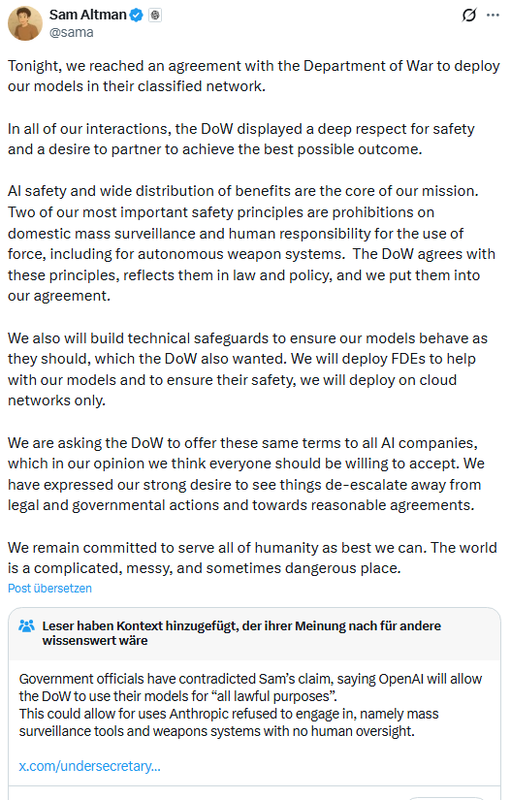

Im heise-Artikel hier ist auch zu lesen, dass Sam Altman mit OpenAI wohl willig einen Deal mit dem Pentagon eingegangen ist. Ich habe mal einen Screenshot der Altman-Verlautbarung samt den Anmerkungen von Lesern auf X gepostet (verlinkt ist der obige Tweet auf xcancel.com). Das dürfte noch heftige Diskussionen um diese OpenAI-Entscheidung, ihre LLMs in klassifizierten Umgebungen bei US-Militär einzusetzen, geben.

Bei Apple ist Antrophic Cloud nach dem Bann durch das Pentagon auf Platz 2 der Liste der beliebtesten kostenlosen Apps hochgeschossen, wie CNBC hier berichtet. Ergänzung: Die neuesten Entwicklungen sind im Beitrag Nach Anthropic-Rauswurf beim US-Verteidigungsministerium springt OpenAI ein zu finden.

MVP: 2013 – 2016

MVP: 2013 – 2016

Wir finden es richtig super, dass Anthropic gegenüber dem Pentagon so standhaft und ehrenwert auftritt.

Auch dass Google und OpenAI die Zusammenarbeit mit der US-Regierung aus ethischen Gründen verweigern und damit Anthropic nach dem Motto "Gemeinsam sind wir stark" zur Seite stehen, freut mich sehr zu sehen.

Das macht mich auch glücklich. Das offizielle Motto lautet "We Will Not Be Divided" (https://notdivided.org/). Danke für die guten Neuigkeiten, Günni.

Von hier aus auch Danke an Günni für diese tollen Neuigkeiten zum Frühlingsanfang. Das ethische Verhalten von den drei standhaften KI-Anbietern stimmt und auch hoffnungsfroh.

Diese News erhellen auch meinen Start in den Frühling.

Ehrlich gesagt hätte ich nicht damit gerechnet, dass sich Anthropic, Google und OpenAI gemeinsam gegen die US-Regierung stellen.

Hut ab!

Ich hätte bestimmt nicht so viel Mut.

Danke für diese guten Neuigkeiten, Günni! Es ist richtig schön, deinen Blog zu lesen.

> Auch dass Google und OpenAI die Zusammenarbeit mit der US-Regierung aus ethischen Gründen verweigern

Hat zumindest bei OpenAI nicht lange gehalten (typisch Sam Altman eben):

> OpenAI agrees with Dept. of War to deploy models in their classified network:

> https://news.ycombinator.com/item?id=47189650

> https://news.ycombinator.com/item?id=47193478

Cool, es gibt ja doch noch Menschen mit Hirn und Charakter – sogar in den USA.

Soll Trump doch KI bei den Chinesen einkaufen, die würden ihm sicher alles versprechen, was er sich wünscht…

Dass er nicht der einzige Lügner ist, der seine Versprechen bricht, merkt er spätestens, wenn seine abgefeuerten Waffen mit CN-KI alle eine 180° Wende machen… "return to sender";)

Pentagon, neuerdings als Kriegsministerium bezeichnet – bezeichnest du es so Günter, oder woher kommt der Hinweis?

Falls ja, warum erst jetzt diese Kennzeichnung?

Deine Abneigung gegen Trump ist ja allerseits bekannt, aber das du es hier immer wieder "predigst" ist schon auffällig…

Du kannst den Kommentar gerne mal wieder "ausblenden" oder ihn zulassen und deinen Kommentar abgeben – ändert nur nichts an deiner Einseitigkeit;)

Zu "Pentagon, neuerdings als Kriegsministerium bezeichnet – bezeichnest du es so Günter, oder woher kommt der Hinweis?" – wenn ich mich nicht ganz ins Boxhorn jagen ließ, hat Hegeseth das United States Department of Defense (DOD) in Department of War (DOW) umbenannt. Wikipedia gibt hier beide Bezeichnungen an. Ich hatte diese Bezeichnung in den letzten Wochen dann mehrfach in US-Artikeln gelesen – sonst wäre es mir vermutlich nicht aufgefallen.

Als Randinfo:

"War Department" oder "Department of War" wird schon länger intern als Name/Nickname vom DoD benutzt.

Ursprung des Namens war das Anti-War Gruppen, seit 50+ Jahren, das DoD immer als WD/DoW bezeichnet haben. ¯\_(ツ)_/¯

Du solltest mal über deine eigene "Einseitigkeit" nachdenken. ;-)

Das war vor Wochen überall in der Presse.

Wo warst du?

Unter einem Stein?

Bemühe doch bitte einfach eine beliebige Suchmaschine bevor du Günter Polemik oder quasi Fakesnews vorwirftst.

Lasst mal gut sein. Wenn die Attributierung auf meinem Mist gewachsen wäre, hätte Hans-Peter recht gehabt. Da ich diesbezüglich aber neutral bin (ich beobachte nur staunend, was in den USA los ist), hat mich sein Kommentar nicht wirklich tangiert – ich habe es erklärt und gut ist. Dass ich gegenüber der US-Administration und Microsoft sowie den Tech-Riesen nicht als Jubel-Perser unterwegs bin, ist auch allgemein bekannt.

@Hans-Peter – Sorry, sich erst als uninformiert outen und dann sowas raushauen. Das war wohl nix. :-(

Ich sag nur Skynet.

Naja, MuskX macht ja wieder mit, der hat sich wohl mit dem anderen … wieder versöhnt.

Wenn das so gut funktioniert, wie sein ach do tolles "FSD"……

Die KI-Mitbewerber arbeiten schon mit den US-Militär zusammen, so Google mit einen "KI-Rechenzentrum auf Weihnachtsinsel" [heise.de/-11068232] und Meta arbeitet im ganz uramerikanischen Patriotismus mit Lockheed-Martin und Palantir zusammen. [lmy.de/dGOeh] Und als Datensammer haben die beiden Unternehmen genügend Informationen über mögliche personenbezogene, militärische Ziele.

Sam Altman von OpenAI schreibt aktuell:

"Tonight, we reached an agreement with the Department of War to deploy our models in their classified network."

*ttps://xcancel.com/sama/status/2027578508042723599?s=46

(xcancel. com ist ein Ersatz für x. com wo man ohne Anmeldung und ohne direktes Tracking mitlesen kann. Der Link ist bis auf diese Substitution identisch und authentisch.)

Anthropic wurde kurz vorher auf eine schwarze Liste gesetzt:

"Anthropic was blacklisted by Trump"

*ttps://www.cnbc.com/2026/02/27/openai-strikes-deal-with-pentagon-hours-after-rival-anthropic-was-blacklisted-by-trump.html

So kann man es auch bei Heise nachlesen.

https://www.heise.de/news/OpenAI-erhaelt-wohl-Pentagon-Auftrag-nach-Bruch-mit-Anthropic-11193881.html

Komisch ist, dass die Punkte wo sich Anthropic geweigert hat, bei OpenAI auf einmal Ok waren, denn OpenAI weigert sich bei diesen Punkten auch, trotzdem wurde der Deal gemacht. xAI ging wohl (auch) leer aus.

Danke für eure Ergänzungen.

OpenAI verbrennt nach aktuellem Stand 218 Milliarden Dollar zwischen 2026 und 2029, kurz mal das Doppelte als vor einem halben Jahr mit "nur" 111 Milliarden Cash Burn für den Zeitraum noch selbst prognostiziert. Da geht man schon mal Deals ein…

Da bin ich von der aktuellen Entwicklung überrollt worden …

Naja dann wird KI eben als "kriegsentscheidend" eingestuft und somit muss sich das Militär nich an die AGB halten und jede Firma die sich weigert kommt auf die Most Wanted List FBI… neben Terroisten & Co. Die schwächen ja mit ihrer Weigerung aktiv die Landesverteidigung –> Staatsfeind! Was die USA mit Staatsfeinden macht ist ja bekannt… Guatanamo oder auch mal ne Reaper die Ihre Nutzlast abwirft. Collateral Damage ist auch nix um das sich die USA schert.

Oder einfach nur ein präsidential Erlass der das regelt… Trump weis sich da sicher zu helfen. Wenn die "Regierungsaufträge gekündigt werden und ausbleiben oder die Auflagen das Geschäft erschweren… naja dann ist Antrophic auch sehr schnell Geschichte…

Als Firma die Regierung verärgern ist in den USA ne ganz miese Idee!

Das Problem ist, dass die Waffentechnik geradezu auf die Nutzung einer autonomen KI hinausläuft. So verkürzen Hyperschallraketen die Vorwarnzeiten drastisch, Menschen können da kaum noch angemessen reagieren. Um Fehlalarme zu überprüfen, wie es etwa 1983 in der UdSSR gelang, reicht einfach die Zeit nicht mehr. Künftig wird das Motto vermehrt lauten: "Use it oder lose it." Gemeint sind die eigenen Atomwaffen.

Die Crux bei der autonomen KI ist: Sie reagiert anders als Menschen, hat weniger Skrupel. Der österreichische Standard berichtete beispielsweise kürzlich von einem Test mit KIs, die man am King's College London Krieg spielen ließ (GPT 5.2, Claude Sonnet 4, Gemini 3 Flash). Ergebnis: In 95 % der simulierten Spiele hat die KI mindestens eine Atomwaffe eingesetzt.

Anthropic hat vollkommen recht, es ist unverantwortlich und gefährlich, KI autonome Entscheidungen zu übertragen. Es sei denn, man spielt gern mit dem Untergang der Menschheit.

Bein Einsatz von Atomwaffen verlieren beide Seiten, kurz nacheinander. Und Unbeteiligte verlieren auch. Daran ändert auch KI nichts.

Nur wenn beide Seiten Atomwaffen haben… und falls du auf die Automatiken anspielst, die gelten für den Start von Interkontinentalen Atomwaffen… gibt da aber noch weitaus mehr.

Das Jahr 1983 hat angerufen und gesagt man sollte die KIs mal TickTackToe spielen lassen!

Nun, es gab ja bereits unter Ronald Reagan Strategen, die einen begrenzten Atomkrieg für gewinnbar hielten. In diesen Szenarien waren Enthauptungsschläge gegen politische und militärische Kommandozentren extrem wichtig. Und dafür sind Hyperschallwaffen hervorragend geeignet. Aber darum ging es mir gar nicht, sondern vielmehr:

Erstens scheint sich KI weniger als wir Menschen über die Folgen eines Atomkriegs im Klaren zu sein, die gesicherte gegenseitige Zerstörung durch die Zweitschlagsfähigkeit und die fatalen Auswirkungen eines Schlagabtauschs (Nuklearer Winter) fließen jedenfalls kaum in ihre Kalkulation ein. Warum auch immer. Wenn sie in 95 % der simulierten Spiele die Schwelle zur Anwendung von Nuklearwaffen überschreitet, hat sie das offenbar nicht kapiert.

Zweitens ging es mir darum, dass Fehlalarme in der Kürze der Zeit nicht als solche erkannt werden können. Das sind Situationen, in denen ja gerade KEIN Angriff stattfindet, weil man über das Gleichgewicht des Schreckens Bescheid weiß, aber jemand irrtümlich glaubt, er werde angegriffen und müsse rasch reagieren.

Man darf einer KI deshalb keine Entscheidungsgewalt übertragen, aber genau darauf scheint es hinauszulaufen.

https://de.wikipedia.org/wiki/WarGames_%E2%80%93_Kriegsspiele

Arbeitet die US-Regierung dann aktuell ohne KI oder wird dann anstelle der Modelle von Anthropic, OpenAI sowie Google etwas von Mistral, Moonshot, Z, Nous Research, Alibaba, Meta oder Deepseek eingesetzt?

Sie arbeiten jetzt mit OpenAI.

Genau das hatte ich von Sam Altman befürchtet… man muss nur mal ein, zwei beliebige Interviews mit ihm schauen, um sich zu gruseln.

Diese Entwicklung ist verdammt übel.

OpenAI hat eine Zusammenarbeit mit der US-Regierung (offiziell) abgelehnt. Da viele Verträge geheim sind, kann es natürlich trotzdem sein, dass OpenAI, Anthropic und Google sowie die von Franky genannten Anbieter und auch SpaceX (früher xAI) eingesetzt werden.

Laut Golem werden die genannten Modelle genutzt: https://www.golem.de/news/trotz-angekuendigtem-verbot-usa-nutzen-ki-tool-claude-fuer-angriffe-auf-iran-2603-205966.html.

Es freut mich aber trotzdem zu sehen, dass Anthropic, Google und OpenAI GEMEINSAM diese Nutzungsart offiziell verbieten sowie verurteilen.

OpenAI macht das Gegenteil, mal die News lesen vielleicht…

OpenAI ist wohl flexibel. Morgen sind Sie gegen Krieg und übermorgen dafür.

95% der KI Kriegsspiele endeten mit dem Einsatz von Atomwaffen. Heute hat Altman ihnen den Schlüssel übergeben und die Büchse der Pandorra geöffnet.

Ein "Spiel" das keine Seite je gewinnen könnte.

https://de.wikipedia.org/wiki/Tote_Hand_(System)

vs.

Anthropic AI /OpenAI

Oder TIC TAC TOE.

Das Spiel das niemand gewinnen kann.

(Ausser mir natürlich)

Das System hiess damals (vor 43 Jahren) WOPR.

Auch die Hemdsärmligkeit bei Zugängen etc. wurde

bereits rustikal abgehandelt, vieles scheint heute noch zu funktionieren.

https://en.wikipedia.org/wiki/WarGames