Was für ein Wochenabschluss bzw. was für ein Wochenende. Letzten Freitag lief ein Ultimatum des US-Militärs (Pentagon) für den AI-Anbieter Anthropic aus. Der sollte seine AI-Lösung für Waffen und Massenüberwachung freigeben. Anthropic hat sich geweigert und wird rausgeworfen. Sam Altman ist mit OpenAI in diese Lücke rein gegrätscht, sieht sich jetzt aber Nutzerschwund gegenüber. Derweil setzt das US-Militär bei den Luftschlägen gegen Iran Anthropics AI-Lösungen ein.

Was für ein Wochenabschluss bzw. was für ein Wochenende. Letzten Freitag lief ein Ultimatum des US-Militärs (Pentagon) für den AI-Anbieter Anthropic aus. Der sollte seine AI-Lösung für Waffen und Massenüberwachung freigeben. Anthropic hat sich geweigert und wird rausgeworfen. Sam Altman ist mit OpenAI in diese Lücke rein gegrätscht, sieht sich jetzt aber Nutzerschwund gegenüber. Derweil setzt das US-Militär bei den Luftschlägen gegen Iran Anthropics AI-Lösungen ein.

Rückblick: Anthropic-Rauswurf und offener Brief

KI-Anbieter Anthropic hatte einen 200 Millionen US-Dollar schweren Vertrag mit dem Pentagon (US-Verteidigungsministerium, inzwischen laut Eigenaussage "Kriegsministerium") zum Einsatz der KI-Lösung Claude beim US-Militär abgeschlossen.

Dann fordert Verteidigungsminister Pete Hegseth vom Unternehmen die Aufhebung der Sicherheitsvorkehrungen für sein KI-Modell im Hinblick auf die militärische Nutzung in Waffen sowie zur Massenüberwachung. Gerade letzteres ist in den USA wegen der Einsätze der Behörde ICE gegen Einwanderer stark umstritten (liefern doch Unternehmen wie Facebook, Palantir etc. Daten und Software an diese Behörde). Und Anthropic sieht seine KI-Lösung nicht für sicher genug, um diese im Waffenbereich einzusetzen.

Es gab ein Ultimatum des Pentagon, das von Anthropic die Freigabe der KI-Lösung für die genannten Einsatzzwecke verlangte; andernfalls drohe der Rauswurf und die Aufnahme in eine "Black-List". Anthropic blieb standhaft und verweigerte die geforderte Freigabe, worauf US-Präsident Trump den Rauswurf von Anthropic KI-Lösungen in allen US-Behörden binnen 6 Monaten anordnete. Ich hatte im Blog-Beitrag Anthropic AI bleibt gegenüber dem Pentagon standhaft, Bann durch US-Präsident Trump berichtet. The Atlatic skizziert in diesem Artikel den Bruch zwischen Anthropic und Verteidigungsminister.

Offener Brief der Google- und OpenAI-Mitarbeiter

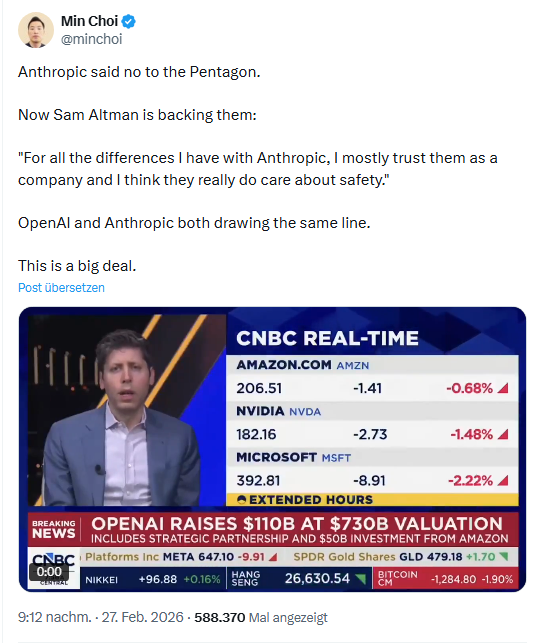

Mitarbeiter der Firmen Google und OpenAI veröffentlichten einen offenen Brief mit dem Titel "We Will Not Be Divided", in denen die jeweilige Unternehmensleitung aufgefordert wurde, nicht beim Pentagon in die Breche zu springen und die eigenen KI-Lösungen als Ersatz anzudienen. Von Google habe ich nichts gehört, von OpenAI sah es zuerst so aus, als ob deren Chef, Sam Altman, diese Position einnehme, wie nachfolgender Tweet suggeriert.

OpenAI springt ein und schließt Vertrag mit Pentagon

Die Verlautbarung von Sam Altman hatte aber nur eine kurze Halbwertszeit. Er teilt zwar die geäußerten Positionen von Anthropic in Bezug auf KI-Sicherheit. Es hinderte aber OpenAI nicht daran, noch am letzten Freitag, den 27. Februar 2026, einen Vertrag mit dem Pentagon zum Einsatz von deren KI-Lösungen abzuschließen.

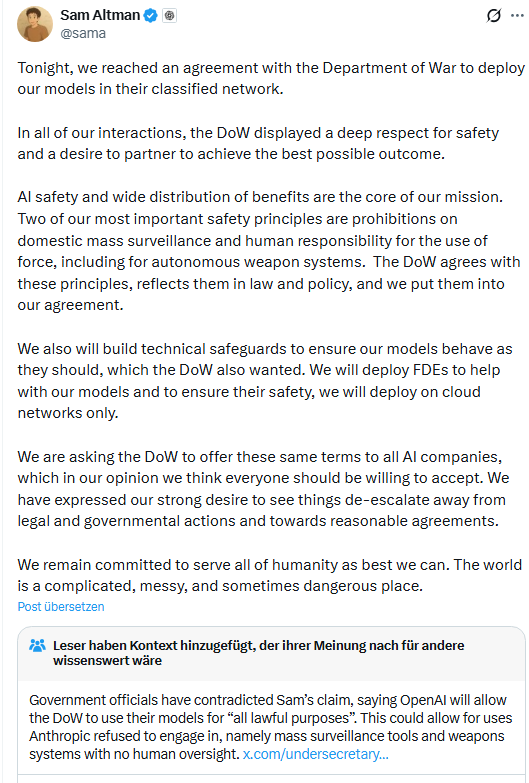

Altman schrieb auf X, dass man die eigenen Positionen von OpenAI mit der Vereinbarung nicht aufgegeben habe, es gäbe "Sicherheitsmechanismen", um den Einsatz in letalen Waffen und zur Massenüberwachung von US-Amerikanern zu verhindern. The Verge hat den Sachverhalt zum 28. Februar 2026 in diesem Artikel ebenfalls beschrieben. Von OpenAI gibt es zudem diese Stellungnahmen zum Vertrag mit dem Verteidigungsministerium. Hier ein kurzer Auszug:

Wir sind der Meinung, dass unsere Vereinbarung mehr Sicherheitsvorkehrungen enthält als alle bisherigen Vereinbarungen für den Einsatz geheimer KI, einschließlich der von Anthropic. Hier sind die Gründe dafür.

Wir haben drei wichtige rote Linien, die unsere Arbeit mit dem DoW leiten und die im Allgemeinen auch von mehreren anderen Spitzenforschungslabors geteilt werden:

- Keine Nutzung der OpenAI-Technologie für die Massenüberwachung im Inland.

- Keine Nutzung der OpenAI-Technologie zur Steuerung autonomer Waffensysteme.

- Keine Nutzung der OpenAI-Technologie für automatisierte Entscheidungen mit hohem Risiko (z. B. Systeme wie „Social Credit").

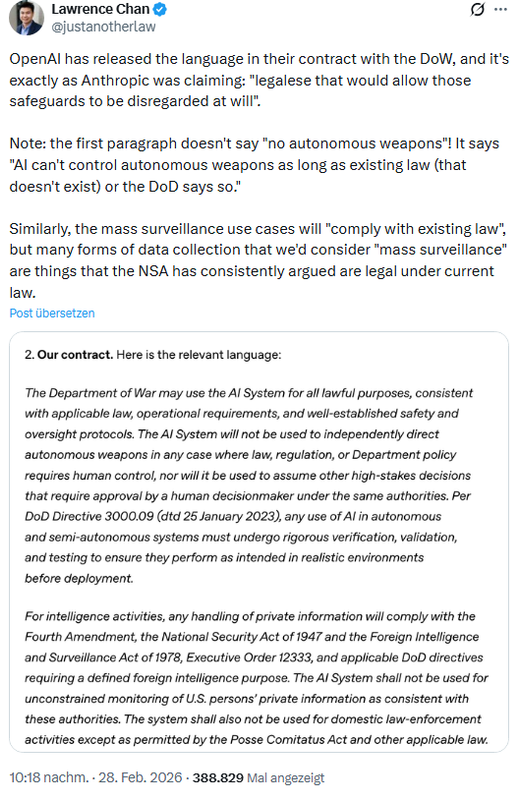

Die obigen Ausführungen von Altman bzw. OpenAI hielten aber nicht lange. Bald wurde darauf hingewiesen (siehe die Anmerkung zu obigem Tweet durch Nutzer sowie auch folgenden Tweet), dass das "Department of War" (Pentagon) das doch anders sieht.

Die AI-Modelle dürften für alle "gesetzlichen Zwecke" verwendet werden – und was gesetzliche Zwecke sind, legt die US-Regierung fest. Auf den Punkt gebracht: OpenAI erklärte sich in der Vereinbarung bereit, US-Gesetze zu befolgen, die in der Vergangenheit eine Massenüberwachung von US-Amerikanern ermöglicht haben. Und das Verteidigungsministerium rückte nicht von seinen Forderungen nach einer Massenanalyse von Daten von US-Bürgern ab.

The Verge beschreibt im Artikel How OpenAI caved to the Pentagon on AI surveillance, wie OpenAI sich zwar den Vertrag sichern konnte, aber wohl alle Positionen "geräumt hat", egal, was Altman behauptet.

Die Hütte brennt: OpenAI in der Falle

Die Entwicklungen des letzten Wochenendes haben dann alles, was bis Freitag galt, über den Haufen geworfen. Das US-Militär führt gemeinsam mit Israel Luftangriffe auf Anlagen des Iran aus, und dabei kommt die KI-Software von Anthropic – trotz Bann – zum Einsatz. Das berichtet das Wall Street Journal in diesem Artikel. Also: Die Vereinbarungen mit Anthropic wurden vom US-Militär einfach beiseite geschoben – und das Abkommen von OpenAI mit dem Pentagon dürfte das Papier nicht wert sein, auf dem es verfasst wurde. Das US-Militär wird die OpenAI-Lösung nach eigenem Gusto – natürlich im Rahmen der "gesetzlichen Grundlagen" verwenden.

Sam Altman und die OpenAI-Führungskräfte sahen sich am Wochenende zu einer Ask me anything (AMA) in sozialen Medien veranlasst. In der AMA-Session sagt Sam Altman, dass die Aufnahme von Anthropic in die schwarze Liste des Verteidigungsministeriums einen "äußerst beängstigenden Präzedenzfall" darstellt. Anthropic sollte nicht als "Sicherheitsrisiko" auf eine schwarze Liste gesetzt werden. Er gesteht aber auch ein, dass OpenAI den Deal mit dem Pentagon überstürzt hat, um "die Lage zu deeskalieren".

Aber die Hütte brennt lichterloh bei OpenAI, Nutzer haben die Aktion QuitGPT ins Leben gerufen. Nach meinen Informationen haben zum Wochenende über 700.000 ChatGPT-Nutzer OpenAI den Rücken zugekehrt. Ob es alles zahlende Nutzer waren, ist mir nicht bekannt. Bleibt jetzt spannend, ob das nur ein Strohfeuer bleibt oder so etwas wie eine "AI-Kernschmelze" einleitet.

Im Kontext passt es gerade, was ich auf X gelesen habe: Forscher von Stanford HAI haben die Datenschutzrichtlinien der sechs größten KI-Unternehmen in Amerika analysiert. Es wurden nicht nur die jeweilige Hauptdatenschutzrichtlinie untersucht, sondern 28 Datenschutzdokumente dieser sechs Unternehmen – also auch alle verlinkten Unterrichtlinien, FAQs und Leitfäden, die über die Chat-Schnittstellen zugänglich sind.

Die Forscherbewerteten alle Dokumente anhand des California Consumer Privacy Act, dem umfassendsten Datenschutzgesetz der Vereinigten Staaten. Hier einige Ergebnisse aus dieser Veröffentlichung: Alle AI-Unternehmen verwenden Konversationen der Nutzer mit den LLMs, um ihre Modelle zu trainieren. Standardmäßig. Ohne Nutzer ausdrücklich darum zu bitten.

Jedes einzelne Unternehmen sammelt standardmäßig die Chat-Daten seiner Benutzer und speist diese in das Modelltraining ein. Einige speichern die Unterhaltungen auf unbestimmte Zeit. Es gibt keine Ablaufzeit. Keine automatische Löschung. Nutzerdaten bleiben einfach dort, für immer, und speisen zukünftige Versionen des Modells.

Einige dieser Unternehmen lassen menschliche Mitarbeiter die Chat-Protokolle (keine anonymisierten Zusammenfassungen) als Teil des Trainingsprozesses lesen.

Bei Unternehmen wie Google, Meta, Microsoft und Amazon, die auch Suchmaschinen, Social-Media-Plattformen, E-Commerce-Websites und Cloud-Dienste betreiben, bleiben die KI-Unterhaltungen nicht innerhalb des Chatbots. Vielmehr werden die Daten mit allem anderen zusammengeführt, was diese Unternehmen bereits über den jeweiligen Benutzer (z.B. den Suchverlauf, Kaufdaten, Aktivitäten in sozialen Medien, Datei-Uploads etc.) wissen. Perfekter Big Brother.

MVP: 2013 – 2016

MVP: 2013 – 2016

Sind wir doch mal ehrlich… selbst wenn ALLE zahlenden Nutzer OpenAI den Rücken kehren würden und OpenA bliebe als Standbein noch immer die US-Regierung (bzw. deren "Kriegsministerium") würden die weiter mehr Kohle machen als alle anderen auf dem Gebiet. Und am Ende würde OpenAI (oder Sam Altman) damit sogar noch mehr als gut wegkommen, weil den meisten US-Amerikaner ja einer abgeht wenn es um "Patriotismus" geht und nichts anderes ist genau das was Altman/OpenAI jetzt macht, wenn es anstelle von Anthropic für die US-Regierung die Kriegsmaschinerie "unterstüzt".

Macht OpenAI denn Kohle bzw. wirklich Gewinn? Ich glaube es eher nicht, nach dem was ich so gelesen habe hatten die alleine im letzten Jahr 8 Milliarden Dollar Verlust gemacht haben. Zuletzt war noch der Deal mit NVIDIA geplatzt, wo ja mal von 100 Milliarden Dollar die Rede war, die NVIDIA in OpenAI investieren wollte. Wenn der Deal dann überhaupt stattfindet werden es wohl so max. 10 Milliarden sein.

Sam Altman und seine Best-Buddies sind fein raus, ob da nun 1 Mrd + oder 10 Mrd. – stehen spielt für die keine Rolle. OpenAI bekommt über "Finanzierungsrunden" ja stetig neues Kapitel hinterhergeworfen.

Entscheidender würde ich eigentlich Google sehen, denn die haben mit Gemini eigentlich als Einzige bisher ein funktionierendes Geschäftsmodell im Bereich KI. Ist bei Google im Gesamtkontext natürlich auch einfacher, aber auch technisch hat Gemini nicht nur aufgeholt, sondern ist vermutlich schon längst vorne. Falls jetzt wirklich x Leute von OpenAI weggehen, dann werden die ja irgendwo hingehen.

Aber im Endeffekt, welche KI auch immer… es wird immer klarer, dass wir in einem Zeitalter der zunehmenden Rechtlosigkeit leben und im zunehmenden Chaos, da spielt das alles nur noch eine zunehmend untergeordnete Rolle. Anders als der Stau bei der Tankstelle heute… kleine Vorspeise vor der nächsten Katastrophe nach Corona, Ukraine…

Auch ein sehr interessanter Beitrag dazu: https://garymarcus.substack.com/p/the-whole-thing-was-scam

> Let that sink in. Altman had secretly been working on the deal since Wednesday.

> – before he announced his support for Dario

> – before Trump had denounced Anthropic

> – but after Brockman had donated 25M to Trump's PAC

Tja, es findet sich immer ein verlogener, amoralischer Konkurrent, der nur allzugerne den Deal übernimmt – bei den Amis ist das ja fast schon normal…hauptsache die Kasse klingelt. Und ehrlich gesagt glaube ich nicht, dass sich so viele von OpenAI abwenden, dass da eine Umkehr des Konzerns stattfinden wird.

Irgendwo hatte ich gestern gelesen, dass versucht wird, Anthropic nun in die EU zu holen…schaunmermal.

noch sieht man (zumindest hier) nix:

https://gs.statcounter.com/ai-chatbot-market-share#daily-20260130-20260228

Da war die Gier nach dem Vertrag größer als die hoffentlich wenigstens noch vorhandenen guten Vorsätze, unter denen OpenAI einst gegründet wurden. Dem Sam steht wegen der Milliardenverluste zwar noch nicht das Wasser bis zum Hals, aber es steigt wohl, und das wäre ein Stöpsel zum Ziehen, um dieses Szenario abzuwenden. Inzwischen versucht er laut Winfuture wohl etwas zurück zu rudern, aber ob die US-Regierung einen abgeschlossenen Vertrag nochmal revidieren lässt, das bezweifle ich stark. Vertrag ist Vertrag und alles andere wäre Vertragsbruch mit Konventionalstrafe, unamerikanisch, unpatriotisch, terroristisch und wie auch immer Trump das bewerten wird.

Sam Altman hatte nie gute Vorsätze.

Skynet mit besserem Marketing. Was soll da schon schiefgehen?

Sam Altman und der Vorstand…

Was machen wir, der Vertrag mit der US Regierung muss schnell unter Dach und Fach gebracht werden, bevor Anthropic doch einlenkt. Eine Stimme: "Unsere Legal Abteilung ist derzeit leider unterbesetzt – die Grippe Welle…"

Langes Schweigen…

Eine junge enthusiastische Stimme: "Warum lassen wir nicht ChatGPT einfach den Vertrag ausverhandeln?"

Begeisterte Zustimmung und kräftiges Händeschütteln, für die grandiose Idee…

(Markierung als Meme)

Schreibt Du auch unter Peter Girnus auf x?

Ob ich es dort auch poste – oder ob ich als Peter Girnus auf X schreibe?

Leider auf beides ein – Nein, hatte nie einen Account auf X und würde sowieso keinen mehr nehmen seit der Übernahme durch Musk. Außerdem ist mein Englisch nicht so gut ;-) dass es dann richtig rüberkommt.

Aber falls Du einen X Account dort hast, kannst Du es gerne dort posten :)