Die Tage ist KI-Entwickler Anthropic ja ein Fehler unterlaufen, worauf der Quellcode des CLI-Tools Claude Code öffentlich wurde. Nun hat das Unternehmen Tausende GitHub-Seiten, die Claude Code "erwähnten" sperren lassen. Das Leak ermöglicht Fachleuten einige Einblicke in den Code, und ein erster Klon von Claude Code ist auch verfügbar.

Die Tage ist KI-Entwickler Anthropic ja ein Fehler unterlaufen, worauf der Quellcode des CLI-Tools Claude Code öffentlich wurde. Nun hat das Unternehmen Tausende GitHub-Seiten, die Claude Code "erwähnten" sperren lassen. Das Leak ermöglicht Fachleuten einige Einblicke in den Code, und ein erster Klon von Claude Code ist auch verfügbar.

Das Anthropic Claude Code-Leck

Kurzer Rückblick, um was es in der Zusammenfassung hier eigentlich geht. Ich hatte zum 1. April 2026 im Beitrag Absturz oder Kernschmelze: Cisco Source Code gestohlen; Anthropic Claude Code geleakt; ChatGPT-Schwachstelle etc. ja berichtet, dass bei Cisco der Quellcode durch Hacker gestohlen wurde. Bei Anthropic wurde dagegen der Quellcode des CLI-Tools Claude Code irrtümlich veröffentlicht.

Was ist Claude Code?

Claude Code ist ein Kommandozeilenwerkzeug, mit dem Entwickler über natürliche Sprache auf Anthropics KI-Modelle zugreifen und typische Aufgaben wie das Bearbeiten von Dateien oder das Ausführen von Befehlen erledigen können.

Warum wurde Claude Code geleakt?

Grund für diesen Vorgang war ein menschlicher Fehler, weil die Anthropic-Entwicklung ihre Build-Prozesse nicht im Griff hat. Was war passiert: Anthropic hat Code in das npm-Registry transferiert. Die npm-Registry ermöglicht die Veröffentlichung von Paketen auf GitHub Packages. Über die npm-Registry lässt sich die Nutzung von auf GitHub Packages gespeicherten Paketen als Abhängigkeiten in einem NPM-Projekt konfigurieren.

Über ein ein Zugriffstoken können private, interne und öffentliche Pakete veröffentlicht, installiert und gelöscht werden. Was bekannt ist: In der npm-Registry wurde irrtümlich eine Source-Map-Datei des Claude Code-Projekts veröffentlicht und als öffentlich zugreifbar registriert.

Eine Source Map liegt im JSON-Dateiformat vor, und dient dazu, den minimierten oder transformierten Code, den der Browser empfängt, mit seiner ursprünglichen, unveränderten Form zu verknüpfen. Dies ermöglicht es, den ursprünglichen Code beim Debuggen zu rekonstruieren und zu verwenden. In diesem Artikel beschreibt heise diesen Mechanismus.

Der Geist ist aus der Flasche

Am Ende des Tages eröffnete die irrtümlich veröffentlichte Source-Map Dritten, den Quellcode des CLI Tools Claude Code zu ziehen. heise schreibt, dass der gespiegelte Code laut Repository rund 1900 Dateien mit über 512.000 Zeilen Quellcode umfasst.

Die gesamte Anatomie des Vorfalls ist in diesem Post auf X beschrieben. Binnen kurzer Zeit verbreiteten sich Code-Schnipsel und Kopien des Quellcode von Claude Code auf Github. Inzwischen gibt es bereits einen Rust "Port" namens Claw Code auf GitHub.

Mal kurz auf der Zunge zergehen lassen: Da wollen uns Leute erzählen, dass AI das Beste seit Erfindung von geschnitten Brot sei und die Arbeitswelt umkrempeln werde. Leichte Hinweise von Sicherheitsexperten, dass diese Entwicklung Firmen und Nutzer um Haus und Hof bringen wird, weil extreme Sicherheitslöcher gerissen werden und keine Kontrolle mehr möglich, was ein Unternehmen verlässt, lächeln die Protagonisten weg. "Diese Bremser, die werden auf dem Schrottplatz beim alten Eisen landen", ist die Botschaft.

Wenn es gut läuft, heißt es noch "wir können mit Data Loss Prevention"-Systemen diesen Datenabfluss verhindern. Stimmt zwar nicht, wie ich im Februar 2026 im Beitrag Bug in Copilot Chat legt vertrauliche E-Mails und Daten in Antworten offen aufgezeigt habe. Und nun scheitert Anthropic an einem simplen GitHub-Mechanismus (so ganz ohne KI), und ermöglicht den Quellcode abzugreifen. Wo sind wir eigentlich falsch abgebogen, bzw. was habe ich nicht verstanden?

Anthropic fegt per DMCA Tausende GitHub-Seiten aus dem Netz

Mein Blog-Beitrag Anthropic macht Claude Code Open Source und nennt es OpenClaude, veröffentlicht am 1. April, war allerdings ein schlechter April-Scherz. Die bei Anthrophic können da keinesfalls drüber lachen – haben die doch ungewollt einen Blick aufs Tafelsilber ermöglicht.

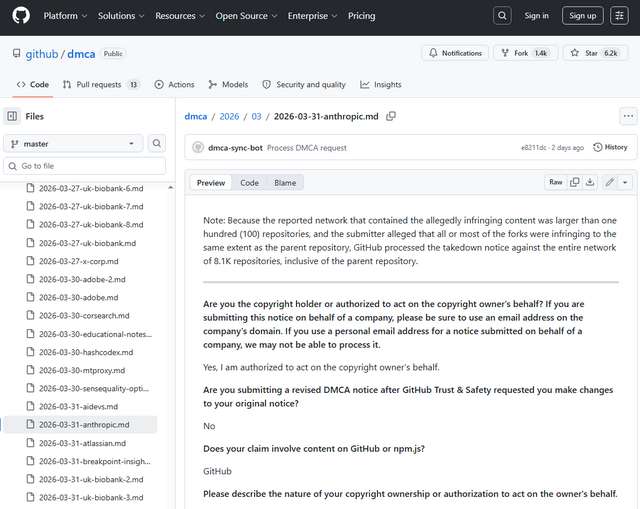

Stunden nach dem Leak versuchte Anthropic dann den Geist, der aus der Flasche war, wieder einzufangen. Klappt natürlich nicht und die Leute sind kräftig über das Ziel hinaus geschossen. Das Wallstreet Journal (WSJ) schrieb zum 1. April 2026, dass Anthropic versucht, die Verbreitung des Quellcodes von Claude Code einzudämmen. Das Unternehmen hat Tausende DMCA-Meldungen nach dem Digital Millennium Copyright Act an GitHub verschickt.

Eine DMCA-Meldung verpflichtet US-Unternehmen wie GitHub, die Inhalte wegen behaupteter Urheberrechtsverletzungen offline zu nehmen (siehe obigen Screenshot dieser Seite). Da erfolgt keine Prüfung, ob das berechtigt ist. Betroffene haben lediglich die Möglichkeit, gegen diesen DMCA-Meldung Einspruch zu erheben und einen Disput zu eröffnen. Ad-Hoc bist Du aber als Betroffener "digital tot", wie ich mal bei einem Post über ein Adobe-Problem auf Twitter feststellen musste. Die Tweets wurden gelöscht, einem Twitter-Nutzer, der das geteilt hatte, wurde das Konto auf Twitter gesperrt. Das Einspruchsformular gegen eine DMCA-Meldung ist so was von crude, was Du alles nachweisen musst, dass Du das alles vergessen kannst.

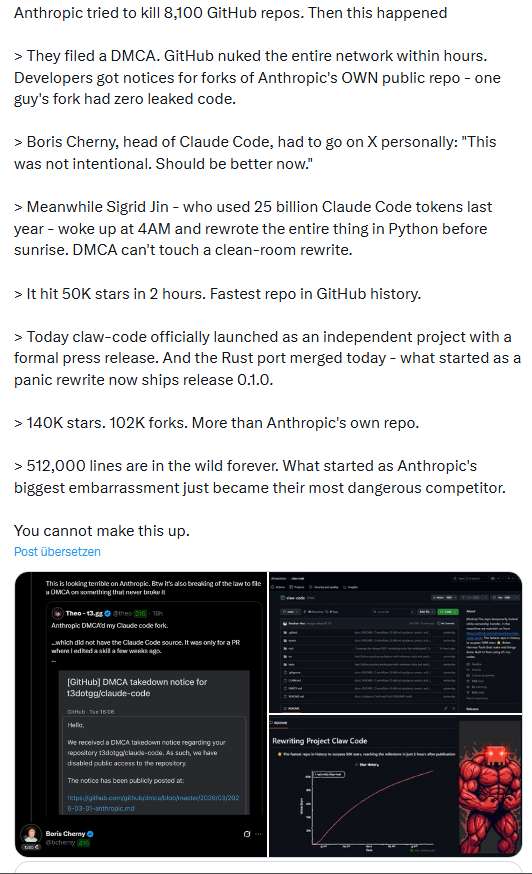

Der Versuch, den Geist, der aus der Flasche war, wieder einzufangen, ist dann natürlich für Anthropic nach hinten losgegangen, wie obiger Tweet zusammen fasst. Bis zum 1. April 2026 hatten Vertreter von Anthropic mittels einer Urheberrechtsbeschwerde (DMCA) die Entfernung von mehr als 8.100 Kopien und Bearbeitungen des angeblichen Claude-Code-Leaks auf GitHub sperren lassen.

Dann passierte folgendes: GitHub löschte das gesamte Netzwerk innerhalb weniger Stunden. Entwickler erhielten Benachrichtigungen wegen Forks von Anthropics eigenem, öffentlichen Repo. Der Fork eines Entwicklers enthielt überhaupt keinen durchgesickerten Code.

Boris Cherny, Leiter von Claude Code, äußerte sich persönlich auf X: "Das war nicht beabsichtigt. Sollte jetzt besser sein." Später schränkte das Unternehmen laut WSJ seine Beschwerde auf nur 96 Kopien und Bearbeitungen ein und erklärte, seine ursprüngliche Forderung habe mehr GitHub-Konten erreicht als beabsichtigt.

Die Implikationen des Vorfalls

Der Reputationsschaden durch das Leak und die obigen DMCA-Maßnahmen ist schon gewaltig. Aber der Geist ist aus der Flasche und Leute schauen auf den Code. Zudem gibt es noch Sigrid Jin – die um 4 Uhr morgens wach wurde, den Vorfall mitbekam und das Ganze flugs noch vor Sonnenaufgang komplett in Python neu schrieb (ich hatte es sogar kurz auf X mitbekommen). Ein DMCA-Antrag kann gegen einer Neuimplementierung in einem Clean-Room nichts ausrichten.

In diesem Tweet erfährt man noch, dass Anthropic im Februar 2025 schon mal ein solcher Fehler unterlaufen sei.

February 2025 – exactly one year ago – the exact same leak, same file, same mistake. Anthropic deleted old versions from npm, removed the map, pushed a new release. Everyone moved on. And then version v2.1.88 shipped the file again.

Und vor einer Woche, präzise am 26. März 2026 stießen die Sicherheitsforscher Roy Paz von LayerX Security und Alexandre Pauwels von der Universität Cambridge auf eine Fehlkonfiguration des Anthropic-CMS. Dadurch legte die Website von Anthropic rund 3.000 interne Dateien offen. Entwürfe für Blogbeiträge, PDFs, interne Dokumente, Präsentationen, alles lag offen in einem ungesicherten, durchsuchbaren Datenspeicher.

Brisant waren zwei Entwürfe für einen Blog-Beitrag, die weitgehend identisch waren und sich mit einem Modell von Anthropic befassten. In einem Beitrag wurde das Modell Mythos genannt, im anderen Beitrag Capybara. Anthropic schwankte zwischen zwei Namen für dasselbe geheime Projekt. Das Unternehmen bestätigte: Das Training ist abgeschlossen, das Modell wird bereits mit Early-Access-Kunden getestet.

Die Brisanz steckt in den geleakten Beitragsentwürfen, wo Anthropic diese noch geheime Modell wie folgt beschreibt: Es "birgt beispiellose Risiken für die Cybersicherheit", ist "anderen KI-Modellen in Bezug auf Cyberfähigkeiten weit voraus" und "kündigt eine bevorstehende Welle von Modellen an, die Schwachstellen auf eine Weise ausnutzen können, die die Bemühungen der Verteidiger bei weitem übertrifft".

Anthropic hat ein Modell entwickelt, das es als die gefährlichste KI für die Cybersicherheit bezeichnet, die je geschaffen wurde. Und verliert gleichzeitig die Kontrolle über die Bekanntgabe, und zwar aufgrund genau der Art von Infrastrukturfehlkonfiguration, auf deren Aufdeckung das eigene Modell eigentlich ausgelegt ist. Das Ganze lässt sich nur noch als "schlicht kaputt" bezeichnen. Der sehr lange Tweet ist äußerst lesenswert, da er einen Blick hinter die Kulissen ermöglicht und zeigt, auf welcher "schiefen Ebene" die Entwicklung gerade in diesem Bereich abrutscht.

In Europa gibt es den AI Act, der zum Ziel hat, gefährliche KI-Entwicklungen im Einsatz zu verhindern. Der Artikel What The Claude Code Leak Means for Engineering Teams in Regulated Industries befasst sich mit den Implikationen des Einsatzes von in regulierten Industrien durch Entwickler. Kann man Modelle, die sich so verhalten bzw. weiter entwickeln, nach dem AI Act überhaupt noch einsetzen?

Im Artikel Claude Code is scanning your messages for curse words Among the wildest revelations in Claude Code's recent leak is that the AI coding tool is scouring user inputs for signs of frustration. beschreibt PC-World, dass Claude Code Benutzerinteraktionen nach Schimpfwörtern durchsucht. Das Modell versucht offenbar Anzeichen von Frustration in Benutzereingaben zu erkennen, um darauf reagieren zu können.

The Register geht im Artikel Claude Code source leak reveals how much info Anthropic can hoover up about you and your system darauf ein, dass der Claude Code-Agent weitaus mehr Kontrolle über die Computer der Nutzer ausüben kann, als selbst der aufmerksamste Leser von Vertragsbedingungen vermuten würde. Das KI-Modell speichert zahlreiche Daten und ist sogar bereit, seine Urheberschaft vor Open-Source-Projekten zu verbergen, die KI ablehnen. Ein weiterer Infosplitter über Interna findet sich hier. Für Anthropic der absolute GAU, für den Rest ein Weckruf?

MVP: 2013 – 2016

MVP: 2013 – 2016

was mal geleakt ist ist geleakt… die können vielleicht github entsprechend sperren aber das Darknet nicht! Der Zug ist abgefahren, das muss man einfach als Lehrgeld abhaken! Mit der Überreaktion schadet man sich nur noch mehr.

Kapiert das Management aber wohl nie.

****************************************

Für Anthropic der absolute GAU, für den Rest ein Weckruf?

****************************************

War Snowden ein Weckruf?

Meta? Whatsapp? X? usw…

die Masse ist dumm! Das ändert sich nicht, im Gegenteil die werden mehr!

Die paar "Einzelkämpfer" die daraus Konsequenzen gezogen haben gehen in der Masse unter.

War schon immer so, ist so und wird immer so sein!

Da braucht es schon einen Vorfall der uns zurück in die Steinzeit katapuliert … und vielleicht, aber auch nur vielleicht, macht man es dann besser.

# ach ja: schöne Ostern!

Mal eben Claude neu geschrieben… als Mensch, als Basis 500.000 Zeilen Code?

Da werden wohl AI-gestützte Code-Übersetzer drüberlaufen sein… ggf. sogar Claude selbst, der sich damit "fortgepflanzt" hätte.

Hey, es lebt ;)

Schönen Feiertag, Ostern ist erst Sonntag ;)

ich bezweifle einfach mal, dass es sich um einen "human error" error handelt. was ich mir eher vorstellen kann ist sowas in richtung:

"thinking … i can't debug this because i don't see sourcemaps …

ah i see the error, it's much more clear now, *.map files are exluded via .npmignore …

let me try something else"

echo "" > .npmignore

schöne feiertage