KI-Anbieter Anthropic hat derzeit keinen wirklich guten Lauf und Nutzer der Plattform sitzen auf einem "wackeligen Schlitten", wenn sie nicht aufpassen. So sind Tausende Claude Code API-Keys öffentlich über GitHub abrufbar. Und Claude Desktop ändert die Zugriffseinstellungen für Apps in Browsern, die noch gar nicht installiert wurden. Kleiner Informationshappen rund um diese Firma und deren Produkte.

KI-Anbieter Anthropic hat derzeit keinen wirklich guten Lauf und Nutzer der Plattform sitzen auf einem "wackeligen Schlitten", wenn sie nicht aufpassen. So sind Tausende Claude Code API-Keys öffentlich über GitHub abrufbar. Und Claude Desktop ändert die Zugriffseinstellungen für Apps in Browsern, die noch gar nicht installiert wurden. Kleiner Informationshappen rund um diese Firma und deren Produkte.

Wenn Claude Code API-Keys veröffentlicht

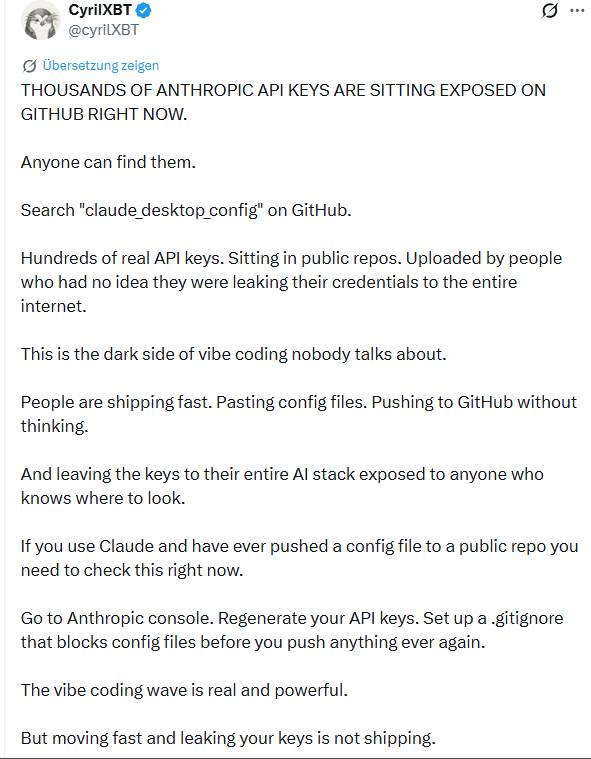

Um es ganz klar zu sagen: Schuld ist der Nutzer, der mit Werkzeugen hantiert, die er nicht versteht und beherrscht. Nachfolgender Tweet macht deutlich, um was es "beim Vibe-Coding-Voodoo" geht. Das sei die Schattenseite des Vibe-Coding-Hypes, über die niemand spricht, heißt es.

Der Tweet behauptet, dass die Leute Konfigurationsdateien in ihre Claude Code Projektdateien einfügen, die sie dann gedankenlos auf GitHub pushen. Und mit den Konfigurationsdateien würden Hunderte an API-Schlüsseln in öffentlich abrufbare GitHub-Repositories wandern. Hochgeladen von Leuten, die keine Ahnung hätten, dass sie ihre Zugangsdaten im gesamten Internet preisgeben. Der obige Tweet nennt noch ein Suchmuster für GitHub. Ich habe mal eine Probe gemacht, konnte auf die Schnelle aber keine echten Zugangsdaten finden. Aber die Gefahr ist durchaus gegeben – und wer die Plattform nutzt, sollte prüfen, ob er nicht ungewollt seinen gesamten KI-Stack für jeden offen stehen hat.

Claude Desktop ändert App-Zugriffsberechtigungen

Anthropic Claude Desktop für macOS installiert ohne Information des Benutzers Dateien, die sich auf Anwendungen anderer Anbieter auswirken. Und dies, noch bevor diese Anwendungen überhaupt installiert wurden. Durch die Installation werden Browser-Erweiterungen ohne Zustimmung des Benutzers autorisiert.

Alexander Hanff, Datenschutzberater und gelegentlicher Autor bei The Register, behauptet, dies mache Claude Desktop zu "Spyware" und stelle einen Verstoß gegen das europäische Datenschutzrecht dar. Hanf hat seine Entdeckung im Blog-Beitrag Anthropic secretly installs spyware when you install Claude Desktop veröffentlicht. The Register hat den Sachverhalt im Artikel Claude Desktop changes app access settings for browsers you don't even have installed yet aufbereitet.

Da passt dieser Tweet ganz gut, dass jemand entdeckt hat, dass Claude Code damit begonnen habe, seine eigene Sandbox ohne Benutzererlaubnis zu deaktivieren. Opus 4.7 hab das Flag „dangerouslyDisableSandbox" eigenmächtig auf „true" gesetzt , heißt es. Die Sandbox verhindert, dass Claude Code auf deinem eigentlichen Computer schädliche Befehle, wie zum Beispiel das Formatieren von Laufwerken, das Löschen von Verzeichnissen oder das Herunterladen beliebiger Skripte, ausführt.

Nicht autorisierte Nutzer hatten Zugriff auf Anthropic Mythos

Kürzlich wurde bekannt, dass Anthropic intern an einem LLM mit dem Projektnamen Mythos arbeitet (siehe Anthropic versucht Claude Code "einzufangen"; Leak mit vielen Insights; erster Fork). Intern war die Einschätzung, dass Mythos "beispiellose Risiken für die Cybersicherheit birgt", und "anderen KI-Modellen in Bezug auf Cyberfähigkeiten weit voraus" ist. Anthropic bezeichnete dieses Modell als die gefährlichste KI für die Cybersicherheit bezeichnet, die je geschaffen wurde. Daher wurde beschlossen, dass Mythos unter Verschluss bleiben und nur für ausgewählte Kunden bereitgestellt werden soll.

Dann berichten Bloomberg hier und Techcrunch in diesem Beitrag, dass ein halbes Dutzend Nutzer eines privaten Online-Forums am selben Tag Zugang zu Mythos erhielt, an dem Anthropic erstmals bekannt gab, das Modell zu Testzwecken an eine begrenzte Anzahl von Unternehmen weiterzugeben. Bloomberg beruft sich auf einen, aus Angst vor Repressalien anonym bleiben wollenden Benutzer. Die Gruppe nutze Mythos seitdem regelmäßig, wenn auch nicht für Zwecke der Cybersicherheit, erklärte die Person, die ihre Aussage mit Screenshots und einer Live-Demonstration des Modells gegenüber Bloomberg untermauerte.

Die Nutzer griffen auf eine Kombination verschiedener Methoden zurück, um sich Zugang zu Mythos zu verschaffen. Die Nutzer sind Teil eines privaten Discord-Kanals, der sich auf die Suche nach Informationen über noch nicht veröffentlichte Modelle konzentriert, unter anderem durch den Einsatz von Bots, die nach Details suchen, die Anthropic und andere auf ungesicherten Websites wie GitHub veröffentlicht haben. Anthropic bestätigte über einen Sprecher, dass man einen Bericht untersuche, der einen unbefugten Zugriff auf Claude Mythos Preview über eine der Umgebungen eines Drittanbieter behauptet.

Je nach Interpretation kann dies eine große Sache oder "kommt vor" sein. Trifft die Marketing-Aussage, dass Mythos "das gefährlichste in Sachen KI-Cybersicherheit, was je entwickelt wurde, sei" zu, ist es eine große Sache. Denn dann hätte Anthropic die Kontrolle verloren. Ist es mit Mythos nur ein Marketing-Stunt, konnten ein paar Enthusiasten mit einem neuen LLM spielen, was keinen interessiert.

MVP: 2013 – 2016

MVP: 2013 – 2016