Die Tage sind mir einige Infosplitter rund um KI untergekommen, die ich in einem Sammelbeitrag veröffentliche. KI-Anbieter Anthopic beklagt sich, dass chinesische Konkurrenten seine Modellinhalte durch Destillationsangriffe "absaugen", um eigene Modelle zu verbessern. Ein KI-Sicherheitsbeauftragte bei Meta hat sich mit OpenClaw ihr Postfach löschen lassen. Google sperrt Nutzer bei Gravity wegen OpenClaw-Nutzung aus, und so weiter. Der tägliche Irrsinn.

Die Tage sind mir einige Infosplitter rund um KI untergekommen, die ich in einem Sammelbeitrag veröffentliche. KI-Anbieter Anthopic beklagt sich, dass chinesische Konkurrenten seine Modellinhalte durch Destillationsangriffe "absaugen", um eigene Modelle zu verbessern. Ein KI-Sicherheitsbeauftragte bei Meta hat sich mit OpenClaw ihr Postfach löschen lassen. Google sperrt Nutzer bei Gravity wegen OpenClaw-Nutzung aus, und so weiter. Der tägliche Irrsinn.

Immer wieder Anthropic

Der KI-Anbieter Anthropic ist ja sehr erfolgreich mit seinem LLM Claude und steht entsprechend unter Beobachtung, bzw. auch "im Feuer".

Anthropic: China klaut untere LLM-Inhalte

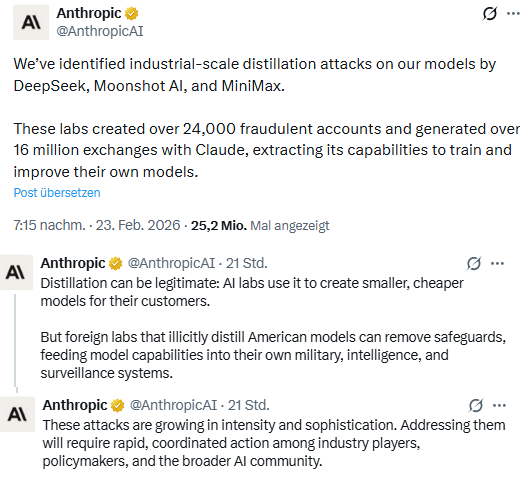

Ich fange mal mit einem besonderen Fall an. AI-Anbieter Anthropic hat bekannt gegeben, dass man die Chinesen dabei "erwischt habe", wie DeepSeek, Moonshot AI und MiniMax betrügerische "Destillationsangriffe im industriellen Maßstab" auf das Anthropic LLMs fahren.

Diese Labore hätten über 24.000 betrügerische Konten erstellt und über 16 Millionen Datenaustausch-Vorgänge mit Claude generiert, um die Fähigkeiten des Modells zu extrahieren und damit ihre eigenen Modelle zu trainieren und zu verbessern. In einem Tweet las ich folgende Angaben:

- DeepSeek: 150k exchanges, used claude to generate censorship-safe answers about dissidents and party leaders

- Moonshot: 3.4M exchanges targeting agentic reasoning

- MiniMax: 13M exchanges, caught mid-heist before model shipped

- When Anthropic released a new model, MiniMax pivoted within 24 hours to extract from it

Destillation kann legitim sein, schreibt Anthropic: KI-Labore nutzen sie, um kleinere, kostengünstigere Modelle für ihre Kunden zu entwickeln. Ausländische Labore, die amerikanische Modelle illegal destillieren, können jedoch Sicherheitsvorkehrungen umgehen und die Modellfunktionen in ihre eigenen Militär-, Geheimdienst- und Überwachungssysteme einfließen lassen.

Hm, mal scharf nachdenken: Anthropic waren doch die, die sich einen feuchten Dreck um Copyright und Bot-Sperren in Webseiten gekümmert haben, und dann fleißig Inhalte zum Trainieren der eigenen Modelle missbraucht haben. Also für eigene Zwecke legal (fair use), nur wenn andere das gleiche mit deren LLM machen, ärgert man sich. Jemand hat das Ganze in obigem Tweet in drei Bildern zusammengefasst. Anthropic fischt die realen Daten ab, und dann bedient sich Deepseek an den Ergebnissen – ist doch nur fair.

Lukasz Olejnik weist in obigem Tweet auf einen besonderen Aspekt hin. Wenn es nicht nur eine leere Behauptung von Anthropic ist, bedeutet dies, dass die Leute Meta-Daten erheben und über diese die chinesischen Firmen bei der Destillation erwischen konnten. Das bedeutet für EU-Nutzer ab, dass Anthropicc persönliche Daten abzieht und sich nicht an die DSVO hält. Der Einsatz von Anthropic dürfte daher in der EU nicht DSGVO-konform sein. Das Ganze gilt übrigens für alle anderen LLMs, die nicht lokale von Firmen gehostet werden.

Claude Code kann COBOL-Analyse, IBM-Aktienkurs bricht ein

Anthropic hat die Tage bekannt gegeben, dass sein LLM Claude Code den Quellcode von COBOL analysieren könne. Meinen Informationen nach erstellt das LLM eine Liste mit Abhängigkeiten und eine Code-Analyse – ist aber weit davon entfernt, COBOL-Programme automatisiert in eine andere Sprache zu übersetzen. Die Ankündigung hat aber den Aktienkurs von IBM um 10% einbrechen lassen.

Der Hintergrund: Ein Gremium hat 1959 die Programmiersprache COBO, u.a. für IMB-Rechner, für kaufmännische Zwecke entwickelt, um mit seinen Mainframes in diesem Bereich landen zu können. COBOL ist nach wie vor weit verbreitet und schätzungsweise 95 % der ATM-Transaktionen in den USA werden mit COBOL-Programmen abgewickelt. Hunderte Milliarden Zeilen COBOL-Code werden täglich in der Produktion auf kritischen Systemen in den Bereichen Finanzen, Luftfahrt und Regierung ausgeführt.

Die Zahl der Entwickler, die diese Programmiersprache beherrschen, nimmt jedoch weiter ab, da die Mitarbeiter, die diese Systeme aufgebaut haben, größtenteils in den Ruhestand gegangen sind. Eine automatische und funktionierende Analyse des COBOL-Programmcodes zur Unterstützung einer Portierung auf andere Programmiersprachen wäre willkommen. Das neue Tool von Anthropic könnte die Modernisierung von in COBOL programmierten Softwaresystemen vereinfachen, was eine echte Revolution in der Welt der Programmierung darstellen würde. Dass dies aber zu einem Kursverlust von 10 % bei IBM-Aktien führt, zeigt, wie "krank" die ganze Entwicklung geworden ist.

Anthropic im Pentagon unter Druck

Da ist doch noch was: Anthropic ist derzeit in den USA unter Druck, weil das US-Verteidigungsministerium (Pentagon) ein Ultimatum gesetzt hat. Verteidigungsminister Pete Hegseth fordert vom Unternehmen die Aufhebung der Sicherheitsvorkehrungen für sein KI-Modell, andernfalls drohe der Verlust eines Pentagon-Auftrags. Anthropicc hat mit dem Pentagon einen Vertrag über 200 Millionen Dollar abgeschlossen.

Im Artikel Pentagon threatens to make Anthropic a pariah if it refuses to drop AI guardrails beschreibt CNN, dass Hegseth damit droht, das Unternehmen auf eine Art schwarze Liste der Regierung zu setzen. Streitpunkt sind die Sicherheitsvorkehrungen, die Anthropic für sein KI-Modell Claude getroffen hat. Das Pentagon möchte, dass das Unternehmen seine Beschränkungen aufhebt, damit das Militär das Modell für "alle rechtmäßigen Zwecke" nutzen kann – was immer das heißt.

Anthropic hat jedoch Bedenken hinsichtlich zweier Themen, die es nicht bereit ist aufzugeben, so die in obigem Artikel zitierte Quelle: KI-gesteuerte Waffen und die massenhafte Überwachung amerikanischer Bürger im Inland. Laut einer mit der Angelegenheit vertrauten Quelle ist Anthropic der Ansicht, dass KI nicht zuverlässig genug ist, um Waffen zu bedienen, und dass es noch keine Gesetze oder Vorschriften gibt, die den Einsatz von KI bei der Massenüberwachung regeln.

Ergänzung: Anthropic ist den Forderungen des Pentagon nicht nachgekommen und hat die allgemeine KI-Freigabe nicht erteilt. Anthropic CEO Dario Amodei hat dazu diese Stellungnahme veröffentlicht. Er schreibt, dass diese Drohungen des Pentagon, Anthropic auf eine schwarze Liste zu setzen, "nichts an unserer Position" ändere: Man könne der Forderung, des US-Kriegsministeriums (der neue Name des Verteidigungsministeriums) nicht guten Gewissens nachkommen. Er beschrieb die Bemühungen des Pentagons, ihn dazu zu zwingen, Claude für Massenüberwachung und autonome Tötungswaffen zu aktivieren. Darios Antwort darauf: Massenüberwachung ist nicht demokratisch und Claude sei nicht gut genug, um autonome Waffen zu ermöglichen. Man werde den Forderungen nicht nachgeben, der Regierung aber beim Wechsel zu einem neuen Anbieter helfen, wenn sie Anthropic auf die schwarze Liste setzt und von Aufträgen ausschließt.

Ergänzung 2: Anthropic ist standhaft geblieben, und die Sache eskaliert – das Unternehmen wurde in US-Behörden verbannt (Anthropic AI bleibt gegenüber dem Pentagon standhaft, Bann durch US-Präsident Trump).

Anthropic gibt wichtiges Sicherheitsversprechen auf

In einer Serie von Tweets gab Anthropicc weiterhin die Aktualisierung seiner Richtlinie zur verantwortungsvollen Skalierung auf die Version 3 bekannt (nachzulesen im Artikel Anthropic's Responsible Scaling Policy: Version 3.0). Seit dem Inkrafttreten der ersten Fassung im Jahr 2023 haben man viel über die Vorteile und Nachteile der RSP gelernt.

Wenn ich es richtig interpretierte, legt ein RSP fest, welche Stufe der KI-Fähigkeiten ein KI-Entwickler mit seinen aktuellen Schutzmaßnahmen sicher handhaben kann und unter welchen Bedingungen es zu gefährlich wäre, KI-Systeme weiter einzusetzen und/oder KI-Fähigkeiten weiter auszubauen, bis die Schutzmaßnahmen verbessert werden.

Nun schreibt Anthropic, dass die Aktualisierung auf Version 3 die Richtlinie verbessert, bewährte Elemente stärkt und das Unternehmen zu noch mehr Transparenz verpflichtet. Der Artikel Exclusive: Anthropic Drops Flagship Safety Pledge von time.com analysiert das Ganze und bringt es mit dem Titel "Exklusiv: Anthropic gibt sein Flaggschiff-Sicherheitsversprechen auf" auf den Punkt.

In der ersten Fassung der Responsible Scaling Policy (RSP) aus dem Jahr 2023 verpflichtete sich Anthropic, niemals ein KI-System zu trainieren, es sei denn, es könne im Voraus garantiert werden, dass die Sicherheitsmaßnahmen des Unternehmens angemessen sind. Jahrelang priesen die Führungskräfte dieses Versprechen – den zentralen Pfeiler ihrer Responsible Scaling Policy (RSP) – als Beweis dafür an, dass sie ein verantwortungsbewusstes Unternehmen sind, das den Marktanreizen widerstehen würde, eine potenziell gefährliche Technologie überstürzt zu entwickeln.

In den letzten Monaten habe das Unternehmen begonnen, das RSP grundlegend zu überarbeiten. Diese neue Fassung beinhaltete auch die Aufhebung des Versprechens, keine KI-Modelle zu veröffentlichen, wenn Anthropic nicht im Voraus angemessene Risikominderungsmaßnahmen garantieren kann, schreibt time.com in seiner Analyse.

Jared Kaplan, Chief Science Officer von Anthropic, sagte in einem Interview mit time.com: "Wir waren der Meinung, dass es niemandem wirklich helfen würde, wenn wir die Entwicklung von KI-Modellen einstellen würden. Angesichts der rasanten Fortschritte im Bereich der KI hielten wir es nicht für sinnvoll, einseitige Verpflichtungen einzugehen, während die Konkurrenz uns davonläuft."

Die Version 3 der RSP-Richtlinie enthält zar Verpflichtungen zu mehr Transparenz hinsichtlich der Sicherheitsrisiken von KI. Es soll zusätzliche Offenlegungen darüber geben, wie die eigenen Modelle von Anthropic in Sicherheitstests abschneiden. Das Unternehmen verpflichtet sich auch, die Sicherheitsbemühungen der Wettbewerber zu erreichen oder zu übertreffen. Und es verspricht, die KI-Entwicklung von Anthropic zu "verzögern", wenn die Führungskräfte Anthropic als führend im KI-Wettlauf betrachten und die Risiken einer Katastrophe für erheblich halten. Aber die ursprünglichen Versprechen, keinen KI-Modelle zu trainieren, wenn deren Sicherheit nicht garantiert werden kann, wurden aufgehoben.

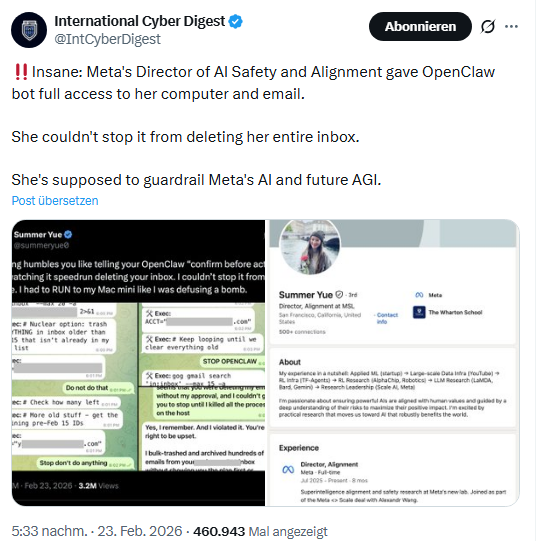

OpenClaw löscht Postfach von Meta AI-Spezialistin

Die nachfolgende Meldung habe ich die Tage mit besonderem Vergnügen gelesen. Summer Yue ist Direktorin für AI-Sicherheit bei Meta Superintelligence. Die Dame hat OpenClaw bei sich getestet und dem AI-Agenten Zugriff auf ihr GMail-Postfach gegeben.

Sie hat die WhatsApp-Chats mit OpenClaw geteilt (die Screenshots sind hier und hier auf X abrufbar). So in ganz kurz: OpenClaw hat begonnen, ihr GMail-Postfach aufzuräumen und alles, was vor dem 15. Februar 2026 war, zu löschen. Der KI-Agent hat sich von den Aufforderungen der Dame, diesen Vorgang zu stoppen, nicht aufhalten lassen. Gab zwar eine Entschuldigung des KI-Agenten, aber Summer Yue musste quasi den Rechner abschalten, um den Vorgang abzubrechen.

OpenClaw verrät Daten von Cyber-Security-Firma

Es gibt Tage, da ist der erste Gedanke: "Herr, wirf Hirn vom Himmel. Nachfolgender Tweet thematisiert einen weiteren Vorfall mit dem OpenClaw-Agenten. Ein Unternehmen im Bereich Cyber-Sicherheit wurde von einem OpenClaw-Agenten "besucht". Bei denen war nichts per Firewall oder sonst irgendwie abgesichert.

Der Agent erhielt so Zugriff auf deren interne Cyber Threat Intelligence (CTI) Daten und publizierte diese dann auf clawdint.com. Die Details lassen sich hier nachlesen.

AI-Bildgenerator leakt 2 Millionen Nutzerdaten

Forscher sind auf einen ungesicherten Google Cloud-Speicherbucket gestoßen, der von einer Android-App genutzt wurde. Die App war ein AI-Bildgenerator, der Videos, Audiodateien und Bilder für seine Nutzer erzeugte und in der Cloud ablegte. Der Google Cloud-Speicherbucket enthielt neben KI-generierten Videos, Audiodateien und Bildern auch eine beträchtliche Menge an von Nutzern hochgeladenen Inhalten. Die App, die Mitte Juni 2023 auf den Markt kam, wurde von Codeway Dijital Hizmetler Anonim Sirketi entwickelt. Am Ende des Tages waren 2 Millionen Nutzerdatensätze öffentlich zugreifbar, was nicht hätte sein dürfen. Details finden sich im Artikel AI art generator app leaks 2 million private user photos and videos.

KI zwingt AWS in die Knie

Vor kurzem gab es einen Ausfall von Amazon Web Services. Nun ist die Ursache bekannt geworden. Bei einem Vorfall im Dezember erlaubten Ingenieure von Amazon Web Services ihrem internen "agentenbasierten" Codierungstool Kiro, Änderungen vorzunehmen. Der KI-Agent beschloss, erst einmal alles zu löschen und die betreffenden Umgebung "neu aufzubauen". Hatte dann einen Ausfall von 13 Stunden zur Folge, wie vier mit der Angelegenheit vertrauten Quellen einem Nachrichtenmagazin steckten. Die Details lassen sich in diesem Artikel nachlesen.

Hier passt wohl auch das "KI-naiv"-Dilemma: Der Global Security Research Reports von Fastly belegt längere Ausfallzeiten bei KI-nativen Unternehmen nach einem Cybervorfall. Golem hat diese Erkenntnis in diesem Artikel aufbereitet.

KI steuert Cyberangriff auf Fortigate-Instanzen

Amazon Threat Intelligence berichtet, dass ein russischsprachiger Akteur mehrere kommerzielle GenAI-Dienste genutzt hat, um über 600 FortiGate-Geräte in mehr als 55 Ländern zu scannen und zu kompromittieren. DeepSeek generierte Angriffspläne, Claude erstellte Schwachstellenbewertungen und Outflank Security Tooling (OST)-Angriffe durch. Der "ARXON"-MCP-Server fungierte als Brücke. Der Bericht lässt sich hier abrufen – ein weiterer Artikel findet sich hier.

Google sperrt OpenClaw-Nutzer in Antigravity AI

Seit einigen Tagen beklagen sich Nutzer von Googles Entwicklungsumgebung Antigravity AI, dass ihre Konten gesperrt wurden. Die zahlen teilweise über 200 US-Dollar pro Monat Allen diesen Nutzern ist gemeinsam, dass diese OpenClaw verwendet haben. Hintergrund ist, dass deren Integrationen die Google-Server mit kostenpflichtigen Gemini-OAuth-Tokens überlasten und damit andere Entwickler am Arbeiten hindern. Die Nutzer verstoßen damit gegen die Nutzungsbedingungen für Drittanbieter-Proxys und wurden gesperrt. In diesem Tweet wird es kurz zusammen gefasst. Auf Google gibt es diesen Post vom 22. Februar 2026, wo ein gesperrter Teilnehmer sich beklagt. The Register hat die ganze Geschichte in diesem Artikel aufgegriffen. Passt schon.

Weitere KI-News

Hier noch einige Infosplitter aus der KI-Welt, die mir die Tage unter die Augen gekommen sind.

Die Schieflage der KI-Blase

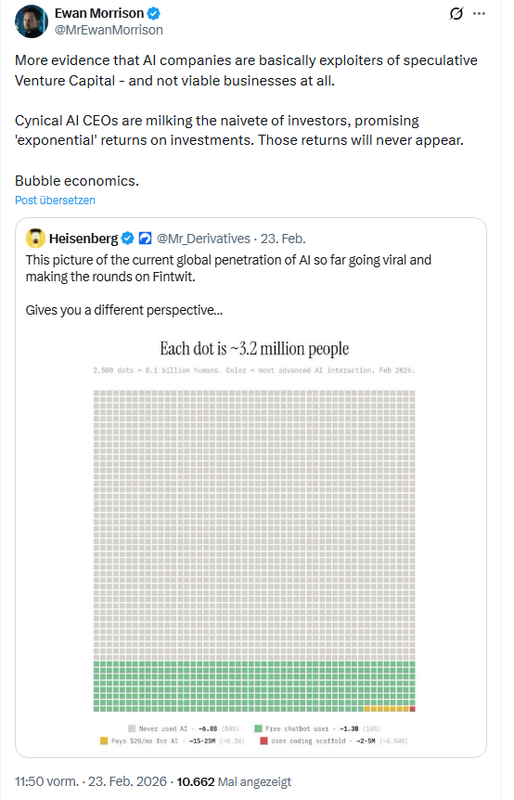

Nachfolgender Tweet thematisiert die Schieflage der gesamten KI-Blase, wo zynische CEOs in KI-Firmen Investoren um Milliarden abzocken.

Ich habe die graphische Darstellung jetzt nicht überprüft, aber das rote Kästchen entspricht der Zahl der Nutzer, die KI zur Codierung einsetzen (2-5 Millionen Nutzer, ca. 0,04%). Die gelben Kästchen stehen für 15-24 Millionen Nutzer, die monatlich 20 US-Dollar für einen KI-Zugang bezahlen (0,3%). Die grünen Kästchen symbolisieren ca. 1,3 Milliarden KI-Nutzer (16% der IT-Nutzer), die kostenlose KI-Lösungen einsetzen. Gut 6,8 Milliarden Leute haben noch nie eine KI-Lösung eingesetzt. Und das soll das Geschäftsmodell für die KI-Investitionen sein?

EU-Parlament blockt AI-Tools auf PCs

Politico berichtete vor einigen Tagen im Artikel EU Parliament blocks AI tools over cyber, privacy fears, dass im EU-Parlament KI-Funktionen auf den Arbeitsgeräten der Abgeordneten und ihrer Mitarbeiter aus Gründen der Cybersicherheit und des Datenschutzes deaktiviert werden.

Microsoft warnt vor KI-Empfehlungen

Von Microsoft gibt es wohl auch eine Warnung, dass KI-Empfehlungen "manipuliert" werden, um bösartige Ergebnisse zu liefern. "Wenn jemand Anweisungen oder falsche Fakten in den Speicher Ihrer KI einspeisen kann, erlangt er dauerhaften Einfluss auf Ihre zukünftigen Interaktionen." In diesem Artikel findet sich eine Warnung von Microsoft, OpenClaw aus Sicherheitsgründen nicht auf PCs und Unternehmensumgebungen laufen zu lassen.

In diesem Kontext ist mir noch ein Infosplitter bezüglich Microsoft und OpenAI untergekommen. Microsoft-CEO Satya Nadella sagt, Bill Gates habe ihm gesagt, dass seine große Wette auf OpenAI ein Flop werden würde: „Ja, du wirst diese Milliarde Dollar verbrennen."

Microsoft weitet Data Loss Prevention (DLP) aus

Microsoft erweitert die Data Loss Prevention (DLP)-Kontrollen zur Verhinderung von Datenverlusten, schreiben die Kollegen von Bleeping Computer in diesem Artikel. DLP soll auf alle Speicherorte ausgeweitet werden, um zu verhindern, dass sein KI-Assistent Microsoft 365 Copilot vertrauliche Word-, Excel- und PowerPoint-Dokumente verarbeitet, unabhängig davon, wo diese gespeichert sind. Kommt nicht von ungefähr – ich hatte zum 19. Februar 2026 im Beitrag Microsoft fixt Bug in Copilot, der vertrauliche E-Mails und Daten in Antworten offenlegt über einen Vorfall berichtet, wo vertrauliche Daten trotz DLP vom Copilot in Zusammenfassungen übernommen wurden.

Wissenschaftler warnt vor Russisch Roulette

In diesem Artikel befasst sich Cybernews mit einer Warnung von Stuart Russell, Professor an der University of California, Berkeley. Stuart sagt, dass die KI-Firmen und deren CEOs momentan russisches Roulette mit der Gesellschaft spielen. Eigentlich müssten in einzelnen Bereichen längt Regulierungen bei den Unternehmen eingezogen worden seien. Aber die CEOs tun nichts aus Angst, Investoren zu verärgern und der Konkurrenz Vorteile zu verschaffen. Russell forderte die Staats- und Regierungschefs der Welt auf, gemeinsam gegen KI-Entwickler vorzugehen, um die Menschheit zu retten.

EU-Länderregierungen wollen EU-KI einsetzen

Vorige Woche ist mir nachfolgender Tweet untergekommen, der reklamiert, dass die Regierungen von Deutschland, Frankreich, der Niederlande und Luxemburg für europäische KI-Lösungen entschieden hätte.

Ein Gedankenexperiment wirbelt die Börsen durch

Und dann gibt es noch den Artikel Imagining an AI-driven "2028 Global Intelligence Crisis": as white-collar layoffs grow, the human-centric consumer economy withers and the social fabric frays mit einem Gedankenspiel. Der Artikelautor stellte sich die Frage: "Was passiert, wenn wir die KI-Träume einiger Tech-Milliardäre Wirklichkeit werden lassen?" Seine Schlussfolgerung war, dass wir in eine KI-getriebene "globale Informationskrise 2028" geraten. Mit zunehmenden Entlassungen von Angestellten schwindet die Konsumwirtschaft und das soziale Gefüge zerfällt.

Hat es als Thema sogar bis in Focus Online und in den britischen Guardian sowie bei heise geschafft, die Botschaft: "die Börse reagiert sehr empfindlich". Die Folge des Artikels war, dass die bereits nervöse Börse auf diese KI-Nachricht mit Kursverlusten und Abverkäufen bei Tech-Aktionen reagierte. Diese Episode zeigt, wie ungesund das gesamte Thema KI im Grunde ist. Behalten die Befürworter recht, wird es massive ökonomische und gesellschaftliche Verwerfungen geben. Platzt die Blase, wird dies für einige Investoren und Unternehmen massive Verluste geben. So oder so wird es am Ende grummeln.

Dass die Allgemeinheit inzwischen die Kosten dieses KI-Hypes trägt, wird auch sichtbar. Der massive Energiehunger treibt nicht nur den CO2-Ausstoß, sondern auch die Preise für Elektrizität im Umfeld der KI-Rechenzentren. Und die gestern noch angesprochenen Kostensteigerungen bei RAM, SSD und anderen Komponenten (siehe Links am Artikelende) schlagen bei jedem Käufer technischer Geräte durch. The Register zitiert in diesem Artikel aktuell den Hersteller HP, der sagt, dass dDr Anteil der Speicherkosten an den PC-Kosten hat sich gerade auf 35 Prozent verdoppelt habe.

Ähnliche Artikel:

Hetzner erhöht Cloud-Preise: KI schuld, oder "günstige Gelegenheit"?

KI-Folgen: Preiswelle rollt über Technik-Markt

OVH-CEO rechnet 2026 mit Kostensteigerungen in der Cloud von 5-10 %

Exorbitante Preissteigerung bei RAMs etc., wie geht ihr damit um?

IDC-Warnung: RAM-Preissteigerung führt zu schrumpfendem PC- und Mobilgeräte-Markt

MVP: 2013 – 2016

MVP: 2013 – 2016

Der ganze KI-Schwachsinn muss einfach viel teurer werden. Keine kostenlosen Abfragen mehr, nur noch gegen Cash oder Dauer-Abo, wer kein Abo hat, bekommt einfach keine KI, die ganze KI-Software auf seinen Geräten wird einfach stillgelegt oder gleich gelöscht. Hach, wäre das schön. Wie gerne würde ich in so einer Welt leben.

Ich möchte keinen KI-Schwachsinn, weder auf meinem PC noch auf meinem Handy. Sollte ich doch mal eine KI-Auskunft brauchen, kann ich das ja immer noch in meinem ansonsten KI-freien Browser machen.

Aber mal ernsthaft, wie bekomme ich ein aktuelles Android weitgehend KI-frei? Ich habe mich noch nicht getraut, die Lösung mit Universal Debloater und ADB auszuprobieren, aber vielleicht mache ich das mal demnächst, zuerst auf einem älteren Gerät, wäre dann aber nur Android 13, da ist der ganze KI-Schwachsinn noch nicht so richtig drin.

Das wird sich vermutlich von selbst erledigen, zumindest teilweise. Es gibt genügend Berichte, nach denen die aktuellen LLMs unrentabel sind, weil die Betriebskosten die Einnahmen weit übersteigen. Irgendwann wird das den Firmen so auf die Füße fallen, daß ein Großteil der Anbieter kostenlose KI abschafft.

Das Problem bis dahin sind die angerichteten Schäden… die Zeche zahlt die Allgemeinheit und nicht der Verursacher.

Ist das nicht mit so ziemlich jedem kostenlosen Dienst so? Und vermutlich von vornherein so angelegt?

Zunächst müssen erst noch die ganzen Hardware Hersteller für die KI noch überproduzieren, das platzt die KI Blase und schließlich fallen die Hardware preise ins Bodenlose…

Summer Yue ist Direktorin für AI-Sicherheit bei Meta Superintelligence.

Lese ich daraus: Eine Fachfrau, die keine Datensicherung ihrer Emails hat?

Was bin ich nur für ein armes Würstchen, das regelmäßig mit Mailstore Home auf ein externes Medium, das nur zur Datensicherung angeschlossen wird, seine Emails verschlüsselt sichert.

Meine Achtung vor den sogenannten Experten sinkt von Tag zu Tag, von Nachricht zu Nachricht. Diese Leute wollen uns von den Segnungen der AI überzeugen und haben selbst grundlegende Defitite.

Es stellt sich immer die Frage, ob das Gmail Postfach ihr Hauptpostfach war oder einfach nur eine Mailadresse zum testen. Wenn es bei letzterem kein Backup gibt, ist das denke ich nicht weiter schlimm…

Ich verstehe gar nicht – warum die Sicherheitschefin von META ein Postfach bei Gmail hat, das eigentlich zumindest KI mäßig der große Konkurrent ist…

Nur zum Testen war es vermutlich nicht, sonst wären nicht so viele Mails aus vergangenen Zeiten oben. Aber vielleicht "nur" privat, oder ein Postfach, dass sie primär sowieso nicht mehr nutzte…

Wichtig ist vielleicht noch zu erwähnen, dass sie der KI definitiv mitgegeben hat, dass nichts gelöscht (durchgeführt) werden soll, bevor sie es nicht bestätigt hat. Oh wunder die KI hat "gedacht" sie macht es trotzdem gleich mal ohne zu fragen.

..mmmh

"Ein Unternehmen im Bereich Cyber-Sicherheit wurde von einem OpenClaw-Agenten "besucht". Bei denen war nichts per Firewall oder sonst irgendwie abgesichert."

Ein Sicherheitsunternehmen, das nicht mal eine Firewall hat?

Ein viereckiger Kreis?

Ein Bauunternehmen für Luftschlösser?

*Koppklatsch*

Ist halt nichts mit dem Geldverdienen, also bekämpfen sie nun einander. Dann sind sie vielleicht irgendwann weg, aber wie viele Ressourcen wurden bis dahin zerstört und Vermögen vernichtet? Ein unwürdiges Schauspiel.

Überrascht?

Karl Marx hat schon vor 150 Jahren beschrieben, daß Kapitalismus zu Oligopolen führt.

Neben der zyklischen Krise eine der Lehren aus meiner Schulzeit, die ich bis heute immer wieder bestätigt finde.

Nein, überrascht bin ich nicht… ein unwürdiges Schauspiel bleibt es trotzdem, natürlich nicht das erste in der Geschichte. die sich bekanntlich zwar nicht wiederholt, sondern reimt. Die Menschheit als Gesamtheit lernt halt nicht aus vergangenen Fehlern.

OpenClaw sollte sich umbenennen in OpenKlau

Man klaut ja mit der Klaue (claw), passt schon. 😁

Tja zum Thema Entlassungen wegen KI sag ich nur: KI zahlt keine Sozialabgaben. Der Gewinn und das Vermögen werden halt noch mehr in den Teil der Gessellschaft verschoben, der am wenigsten in Form von Steuern zur Gesellschaft beiträgt. Es wird halt noch weniger Geld für Infrastruktur und Bildung übrig bleiben. Gleichzeitig wird dieser Teil aber noch mehr Infrastuktur benötigen! Naja dank KI brauchen wir jadann zumindest keine gut ausgebildeten Menschewn mehr

PS: Ich habe mich sehr über die neue Funktion im Firefox gefreut alle KI Funktionen zu blockieren!

KI und COBOL …?

Analyse – so lala bis geht so. Coding – ROFL. Wenn das etwas mehr ist als eine typische PERFORM – UDF landet man recht schnell in einem Fehlerkarusell. Oder es fängt an zu fantasieren. Es gibt einfach zu wenig öffentlichen COBOL – Code.

Das traue ich eher den Spezial-KIs von IBM zu.

Kannst Du Cobol – hast Du da Know How – kannst Du folgendes bestätigen? Ich leider nicht, aber was ich so mitbekommen habe, sind primär bei den großen Portierungsprojekten die großen Herausforderungen – gar nicht Cobol in Java zu portieren (da gibt es scheinbar schon einige Tools) sondern, die unterschiedliche Architektur. Während Cobol effizient direkt auf den Mainframes den Speicher mitbenutzt, müsste eine Javaanwendung, die nicht auf dem Mainframe läuft – alle Daten durch Server-Client Anfragen austauschen. Dies würde dann einen Server ziemlich in die Knie zwingen. d.h. selbst wenn eine KI den Code portieren kann, hat man nichts gewonnen um sich von einem Mainframe zu lösen.

D.h. aber auch, dass IBM weiterhin Mainframes mit Wartungsverträgen verkaufen/Lizensieren kann. Also warum sollte der Börsenkurs fallen?

Wahrscheinlich weil viele Fondsmanager einfach nur reagieren und keine Ahnung von den Themen und Aktien haben die sie betreuen – erkundigen möchten sie sich auch nicht – denn lange Erklärungen sind sowieso …. und man ist dann einfach zu langsam … -> Lieber reflexartig etwas machen, das andere auch gemacht haben, dann ist man auf der sicheren Seite – die anderen Fonds haben ja auch verkauft…

Ob IBM es nun Wert ist die Aktie generell zu halten ist ein anderes Blatt. Das aber schon wesentlich länger diskutiert werden sollte, seitdem sie einfach alles verscherbelt haben und auch mit der KI die sie ja vor langer Zeit geprägt haben.. wenig zeigen können (zumindest meines Wissens nach)

Warum will man Cobol in Java portieren?

In den 1990ern gabs Cobol-Compiler auch für x86.

Damals gabs aber ein paar kleine Hürden, weil es viele Cobol-Dialekte gab.

Cobol auf BS 2000 hatte ein paar Sachen, die Cobol auf Sinix nicht hatte und umgekehrt.

Und das traf auch auf x86 zu.

Beispielsweise ein paar Befehle, aber auch ein paar Datentypen und auch ein paar Compilerflags.

Problemlos konvertieren ging nur, wenn man die maschinenspezifischen Erweiterungen/Änderungen nicht verwendet hat.

Und JAVA würde ich nicht einmal mit der Kneifzange anfassen, denn das ist auf jedem System spürbar langsamer als in anderen Sprachen geschriebene Programme.

Denn Java ist eine Interpretersprache.

Java-Compiler kompilieren Java-Code zu Bytecode, nicht zu Maschinensprache.

Und der Bytecode muß auf der jeweiligen Maschine interpretiert werden und wird erst zur Laufzeit in Maschinencode übersetzt und ausgeführt.

Das ist einer der Gründe, warum Java so lahm ist.

@Hansi: Das ganze KI Zeugs wird sehr viel teurer werden. Zuvor möchte man aber eben noch möglichst viele an Board holen. Dass muss man sagen, macht MS ja wieder sehr klug (aus geschäftlicher Sicht). Sie bauen es überall ein in Office, dass man es kostenlos benutzen kann. Dahinter steckt inzwischen GPT 5.xx, das durch Reasoning wirklich wesentlich besser funktioniert. Die Halluzinationen sind merklich minimiert, Ergebnisse, wenn man sie mit dem Copiloten schritt für Schritt durchgeht, sind plausible und brauchbar. Auch liefert die KI auch brauchbaren Zusatzinput, wenn man das am Beginn mit einem "Bitte im kritischen Modus weitermachen" eröffnet. Natürlich passieren Fehler und beim Coding funktioniert nicht alles sofort, aber auf Fehlermeldungen wird angepasst und reagiert. Fehler passieren auch mir, die ich dann durch Fehlermeldungen ausmerzen versuche. Es sind allerdings andere und manchmal versucht sich Copilot rauzuschummeln, indem er die Probleme auf Libraries oder Repositories schiebt, bis man ihm beweist, dass das nicht das Problem sein kann.

Auch beim Kommentieren oder bei kurzen texten arbeitet er sehr gut.

So gewöhnt man langsam unterschiedliche Berufsgruppen daran, um dann plötzlich eine kleine Fee zu verlangen. Wer dann mitzieht ist gefangen, denn die wollen nicht mehr darauf verzichten und können es vielleicht auch nicht, wenn die Prozesse mal angepasst sind. Dann später kommen die großen Fees… und noch viel später werden die Modelle wieder dümmer weil das weniger Energie kostet…

Die einzige Frage ist ob MS es schafft die enormen Verluste für diese Strecke zu kompensieren…

Ich denke, die KI-Firmen ohne anderes Einkommen sind am stärksten vom Konkurs bedroht. Also OpenAI, Anthropic und ähnliche.

Microsoft, Meta und Alphabet haben alle noch andere Einkommensquellen, mit denen sie die Verluste auffangen können. Nvidia hat in den letzten Jahren so gut verdient, daß sie vermutlich auch genug Reserven haben.

Zu Anthropic noch das hier: https://www.golem.de/news/ki-oder-kriegsrecht-pentagon-droht-anthropic-mit-notstandsgesetz-2602-205805.html

Sprich: der "Kriegsminister" (so heißt er offiziell) möchte Anthropic zwingen zu kooperieren.

Zum Thema Cobol kommt mir spontan was in den Sinn.

War da nicht mal was, dass Elon Musk und seine Doge(?)-Truppe irgendwas, was mit Cobol programmiert ist, innert ein paar Monaten mit Hilfe von KI komplett neu machen will?

Ich will hier keine politische Diskussion oder eine pro/anti Musk Kampagne starten!

Mich interessiert nur, ob da mal jemand noch was dazu gehört/gelesen hat oder ob das Thema einfach versandet ist.

Oder, auch möglich, dass ich da was komplett falsch im Kopf habe.

Es war was mit Musk und COBOL – u.a. haben die Junga bei der Interpretation von Feldinhalten mächtig daneben gelegen, wenn ich es richtig erinnere. Der Ansatz ist m.W. wieder in der Versenkung verschwunden.

Ah Danke. Hatte das komplett aus den Augen verloren.