Nicht schön: Bei Mercor (stellen Trainingsdaten für LLMs für AI-Anbieter bereit) hat es einen Sicherheitsvorfall gegeben. Meta hat die Zusammenarbeit mit Mercor gestoppt und analysiert den Vorfall bei dem "Datenanbieter". Auch OpenAI untersucht laut Mitteilung den Sicherheitsvorfall.

Nicht schön: Bei Mercor (stellen Trainingsdaten für LLMs für AI-Anbieter bereit) hat es einen Sicherheitsvorfall gegeben. Meta hat die Zusammenarbeit mit Mercor gestoppt und analysiert den Vorfall bei dem "Datenanbieter". Auch OpenAI untersucht laut Mitteilung den Sicherheitsvorfall.

Im Grunde untersuchen alle wichtigen US KI-Entwickler einen Sicherheitsvorfall, von dem Mercor betroffen war. Das ist die Essenz aus diesem Wired-Artikel.

Spannend ist die Frage, wer Mercor eigentlich ist (sagte mir nichts). Mercor ist laut Wired eines der wenigen Unternehmen, auf die sich KI-Firmen wie OpenAI, Anthropic und andere KI-Labore bei der Erstellung von Trainingsdaten für ihre Modelle (LLMs) verlassen. Solche Anbieter arbeiten hinter den Kulissen und wahren Diskretion über Auftraggeber.

Mercor beschäftigt ein riesiges Netzwerk menschlicher Auftragnehmer, um maßgeschneiderte, proprietäre Datensätze für diese Labore zu erstellen. Die Datensätze sind in der Regel streng geheim. Sie stellen für die jeweiligen KI-Anbieter das zentrale "Know How" bzw. Produktionsmaterial für Produkte wie ChatGPT und Claude Code etc. dar.

Der Cyberangriff auf Mercor

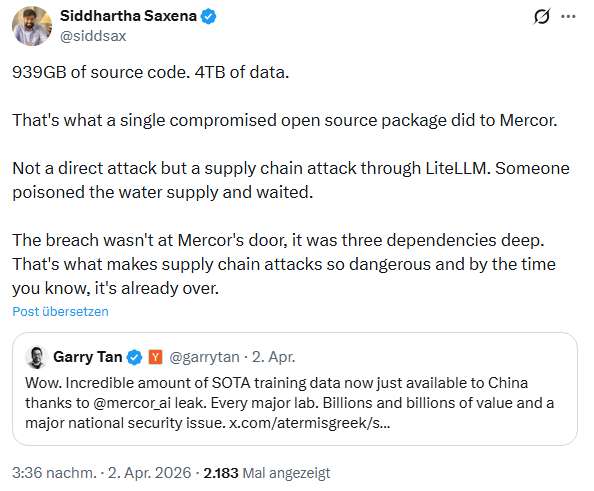

Der "Datenbroker" für LLMs, Mercor, wurde Opfer des Lieferkettenangriffs auf LiteLLM (ich hatte im Beitrag Python-Paket mit 96 Millionen Downloads über simplen Befehl infiziert; 500.000 Anmeldedaten abgezogen? über den Lieferkettenangriff auf LiteLLM berichtet).

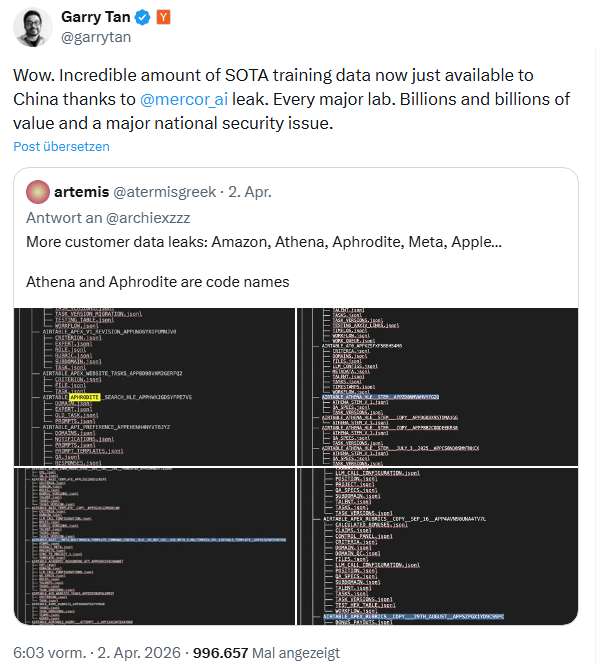

Obiger Tweet berichtet, das Angreifer durch den Lieferkettenangriff auf LiteLLM in der Lage waren, 4 TB Daten (darin enthalten 939 GB Quellcode) von Mercor abzuziehen. Der nachfolgende Tweet von Garry Tan verdeutlich die Brisanz: Es sind wohl "Kundendaten" von Amazon, Athena, Aphrodite, Meta, Apple über das Leck bei Mercor (AI) abgeflossen.

Mercor hat gemäß diesem reddit.com-Thread den Sicherheitsvorfall eingestanden (siehe diesen Screenshot der Mercor-Meldung). HackNotice hat in diesem Beitrag einige Details zusammen getragen. Laut Wired-Artikel habe Mercor den Sicherheitsvorfall in einer E-Mail an die Mitarbeiter am 31. März 2026 bestätigt. Man sei, "wie Tausende anderer Organisationen weltweit" von einem Sicherheitsvorfall betroffen.

Es kommt alles ins Rutschen bei AI-Anbietern

Man muss es so einordnen: Jemand vergiftet den Wassertrog und lauert nun, bis die Beute kommt und sich diesem Trog bedient. Wenn Mercor die Trainingsdaten für die LLMs liefert, die praktisch alle großen US-AI-Anbieter verwenden, wurden diese quasi "vergiftet". Sind Trainingsdaten abgeflossen, könnte die Konkurrenz (auch aus China) auf diese Informationen über die Angebote im Darknet zugreifen. Dann sehen sie, wie einzelne Anbieter ihre LLMs mit Daten trainiert haben und wie diese ggf. damit umgehen.

Der Wired-Artikel macht einen Zirkelschluss: Auftragnehmer von Mercor wurde mitgeteilt, dass Projekte gestoppt seien. Es heißt, den Mercor Auftragnehmern im Meta-Projekt sei nicht mitgeteilt worden, warum keine Stunden mehr abgerechnet werden können. Wired nennt die Chordus-Initiative, ein Meta-spezifisches Projekt, bei dem KI-Modellen beigebracht wird, mehrere Internetquellen zu nutzen, um ihre Antworten auf Nutzeranfragen zu verifizieren. Der Projektleiter informierte Mitarbeiter, dass Mercor derzeit den Projektumfang neu bewertet. Wird so interpretiert, dass Meta die Zusammenarbeit mit Mercor gestoppt hat.

OpenAI hat die Zusammenarbeit zwar nicht gestoppt, heißt es, analysiert aber derzeit, wie sich der oben erwähnte Datenabfluss auf die eigenen LLMs und die betreffenden Produkte auswirkt. Ähnliches gilt für die anderen US-KI-Anbieter, die Trainingsdaten für die LLMs von Mercor bezogen haben.

Ich formuliere es mal so: Nach dem Anthropic Claude Code-Sourcecode-Leck (Absturz oder Kernschmelze: Cisco Source Code gestohlen; Anthropic Claude Code geleakt; ChatGPT-Schwachstelle etc.) brennt bei denen die Hütte und die Konkurrenz reibt sich die Hände. Durch die Kostenexplosion der Hardware-Preise wackeln viele Expansionspläne der AI-Anbieter und die Finanziers stellen Fragen. Und nun kommt der nächste "Sargnagel" in Form einen Datenabflusses um die Ecke. Könnte der nächste Riss im Fundament sein, der das Kartenhaus zum Wackeln bringt.

Ähnliche Artikel:

Databricks mutmaßlich Opfer des TeamPCP LiteLLM-Lieferkettenangriffs

Cybervorfälle und Schwachstellen (April 2026): Sportradar AG, Adobe, Gambio-Onlineshops etc.

Cyberangriffe: Die Linke, niederländisches Finanzministerium, EU-Kommission etc.

Python-Paket mit 96 Millionen Downloads über simplen Befehl infiziert; 500.000 Anmeldedaten abgezogen?

Absturz oder Kernschmelze: Cisco Source Code gestohlen; Anthropic Claude Code geleakt; ChatGPT-Schwachstelle etc.

Anthropic versucht Claude Code "einzufangen"; Leak mit vielen Insights; erster Fork

MVP: 2013 – 2016

MVP: 2013 – 2016